生成逼真交互,英伟达发布AI化身Omniverse Avatars平台

生成逼真交互式AI数字化身

(映维网 2021年11月10日)在昨晚的GTC大会中,英伟达创始人兼CEO黄仁勋介绍了Omniverse(全宇宙)战略的最新进展,并发布了旨在生成逼真交互式AI数字化身的Omniverse Avatars平台。

英伟达在2020年10月开始测试面向企业的实时仿真模拟和协作平台Omniverse,并在今年4月的GTC春季大会推出正式版本。在当时,媒体已经纷纷将这个虚拟工作平台称为“工程师的元宇宙”,包括宝马、爱立信、沃尔沃和Adobe等众多公司都有采用Omniverse。

黄仁勋曾将Omniverse描述成 “一款将3D世界连接至共享虚拟世界的平台”,并宣称它是未来数字孪生技术的基础。

在昨晚的GTC秋季大会,黄仁勋进一步扩展了Omniverse概念,并正式推出Omniverse Avatar和Ominiverse Replicator。前者旨在帮助开发者通过英伟达的Omniverse平台创建可以理解真人自然说话意图的交互式虚拟角色,而后者则是一种用于训练深度神经网络的合成数据生成引擎,从而提供创建训练AI所需的大量数据。Ominiverse Replicator主要面向通用机器人和自动驾驶汽车。

值得一提的是,Omniverse同时新增了英伟达早前发布的一系列AR/VR功能。

1. Omniverse Avatar

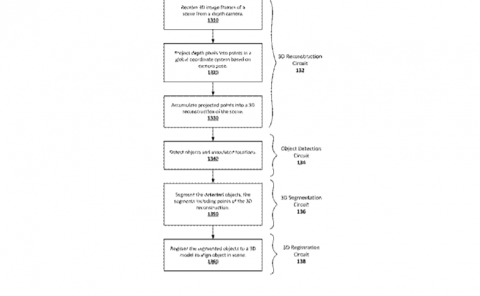

Omniverse Avatar整合了英伟达在语音AI、计算机视觉、自然语言理解、推荐引擎和模拟方面的技术。利用所述平台创建的虚拟形象是具有光线追踪3D图像效果的交互式角色,并能够看见、说话、谈论各种主题,以及合理地理解表达意图。

Omniverse Avatar的主要组成:

Omniverse Avatar所使用的语音AI、计算机视觉、自然语言理解、推荐引擎、面部动画和图像元素是通过以下技术实现:

- 其语音识别基于NVIDIA Riva。这个软件开发工具包可以识别多种语言的语音。Riva还可通过文本语音转换功能生成接近真人的语音反馈。

- 其自然语言理解基于Megatron 530B大型语言模型。该模型可以识别、理解和生成人类语言。Megatron 530B是一个预训练模型,它可以在很少或没有训练的情况下完成句子、回答主题广泛的问题、总结长而复杂的故事、翻译成其他语言,并应对许多它未接受过专门训练的情景。

其推荐引擎由NVIDIA Merlin提供。该框架使企业可以建立能够处理大量数据的深度学习推荐系统,以提出更明智的建议。 - 其感知功能来自用于视频分析的计算机视觉框架——NVIDIA Metropolis。

- 其虚拟形象动画由AI赋能的2D和3D面部动画和渲染技术——NVIDIA Video2Face和Audio2Face驱动。

所述技术都集成在一个应用,并使用英伟达统一计算框架进行实时处理。在打包成可扩展、自定义微服务后,它们将能够通过NVIDIA Fleet Command在多个地点安全地部署、管理和协调。

英伟达指出,Omniverse Avatar为AI助手的创建开辟了道路,而且可以根据各个行业的需求轻松定制。例如,AI助手可以帮助处理数十亿次日常客户服务互动,比如餐厅订单,银行交易,个人预约和预订等,带来更多商机并提升客户满意度。

黄仁勋表示:“智能虚拟助手的前景一片光明。Omniverse Avatar将我们的基础图像、模拟和AI技术结合在一起,打造出一些有史以来最复杂的实时应用。协作机器人和虚拟助手的案例令人难以置信,影响深远。”

2. 通往虚拟世界的新门户

英伟达指出,Omniverse平台将充当物理级准确的3D虚拟世界的结缔组织,并将获得AR、VR和多 GPU渲染等新功能。

当然,Omniverse主要是新增英伟达早前发布过的一系列AR/VR功能,包括:

- NVIDIA CloudXR:这个企业级沉浸式串流框架已经集成到 Omniverse Kit(用于构建原生 Omniverse应用和微服务的工具包),允许用户以交互方式将Omniverse体验串流至他们的移动AR和VR设备。

- Omniverse VR:领先的完全图像、实时光线追踪VR,可支持开发者在平台上构建自己的VR工具,而最终用户可以直接享受VR功能。

- Omniverse Remote:提供AR功能和虚拟摄像头,支持设计师查看通过iOS和Android设备全光线追踪的asset。

团队评论道:“随着Omniverse生态系统和功能的扩展,英伟达打开了通往虚拟世界的新门户。”