2022年07月29日美国专利局新申请AR/VR专利摘选

文章相关引用及参考:映维网Nweon

一共更新了26篇专利。

(映维网Nweon 2022年07月29日)近期美国专利及商标局公布了一批全新的AR/VR专利,以下是映维网的整理(详情请点击专利标题),一共26篇。更多专利披露请访问映维网专利板块https://patent.nweon.com/进行检索,你同时可以加入映维网AR/VR专利交流微信群(详见文末)。

1. 《Magic Leap Patent | Physics-based audio and haptic synthesis(Magic Leap专利:基于物理的音频和触觉合成)》

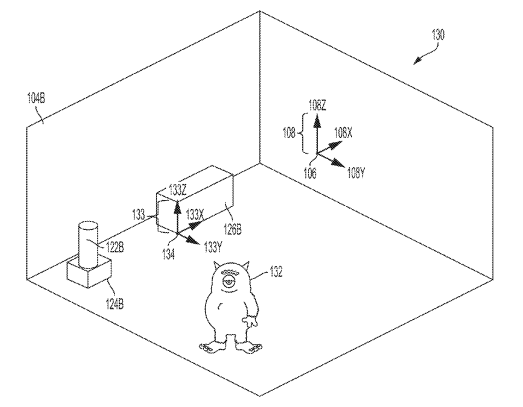

在一个实施例中,专利描述了为混合现实系统生成和呈现虚拟音频的系统和方法。一种方法可以包括确定第一对象和第二对象之间的碰撞,其中第一对象包括第一虚拟对象。可以访问存储一个或多个音频模型的存储器。可以确定存储在存储器中的一个或多个音频模型是否包括对应于第一对象的音频模型。根据一个或多个音频模型包括对应于第一对象的音频模型的确定,可以合成音频信号,其中音频信号基于碰撞和对应于第一对象的音频模型,所述音频信号可以通过头戴式装置的扬声器呈现给用户。根据一个或多个音频模型不包括对应于第一对象的音频模型的确定,可以确定第一对象的声学特性,可以生成基于第一对象的声学特性的定制音频模型,可以合成音频信号。其中,所述音频信号基于所述碰撞和所述定制音频模型,并且所述音频信号可以经由头部可穿戴设备的扬声器呈现给用户。

......(全文 5255 字,剩余 4778 字)

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

映维网会员可直接登入网站阅读

PICO员工可联系映维网免费获取权限