微软专利介绍HoloLens用于视差重投影的时间校正系统和方法

视差重投影的时间校正系统和方法

(映维网 2021年12月31日)尽管现有的混合现实系统可以配置不同类型的摄像头,但通过混合现实设备呈现摄像头捕获的图像依然存在众多挑战。由于摄像头的物理定位与用户眼睛的物理定位属于物理分离,所以不能简单地直接向用户渲染捕获的图像。具体地说,用户眼睛定位和立体摄像头定位之间的垂直偏移将导致视图误差,所以用户将会感知到具有不正确深度的真实世界对象。

在名为“Systems and methods for temporal corrections for parallax reprojection”的专利申请中,微软介绍了一种相关主题的发明。具体来说,其主要解释了一种用于视差重投影的时间校正系统和方法。

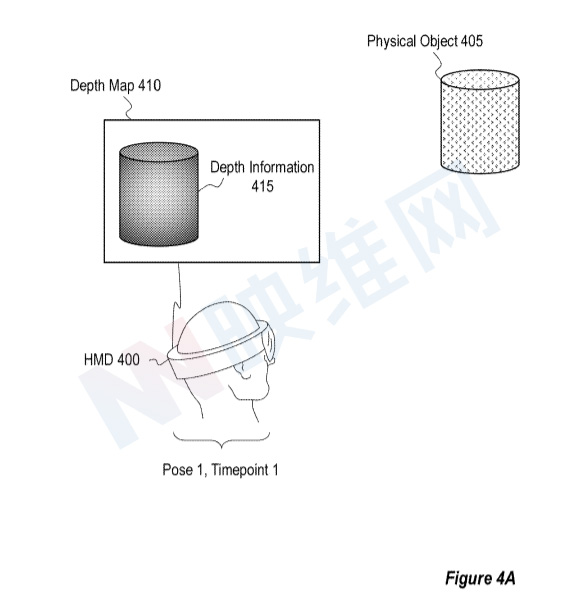

现在注意图4A,图4A示出了头显400生成包括物理对象405的环境的深度映射410。头显400包括立体摄像头对(例如任何模态的摄像头),所述立体摄像头对配置为捕获立体图像对,头显400配置为在其上执行深度计算(例如立体匹配)以生成深度映射410。

......(全文 4028 字,剩余 3691 字)

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

映维网会员可直接登入网站阅读

PICO员工可联系映维网免费获取权限