Facebook提出无需空间标注的3D空间识别方法WyPR

mIOU比以前的技术高出6%

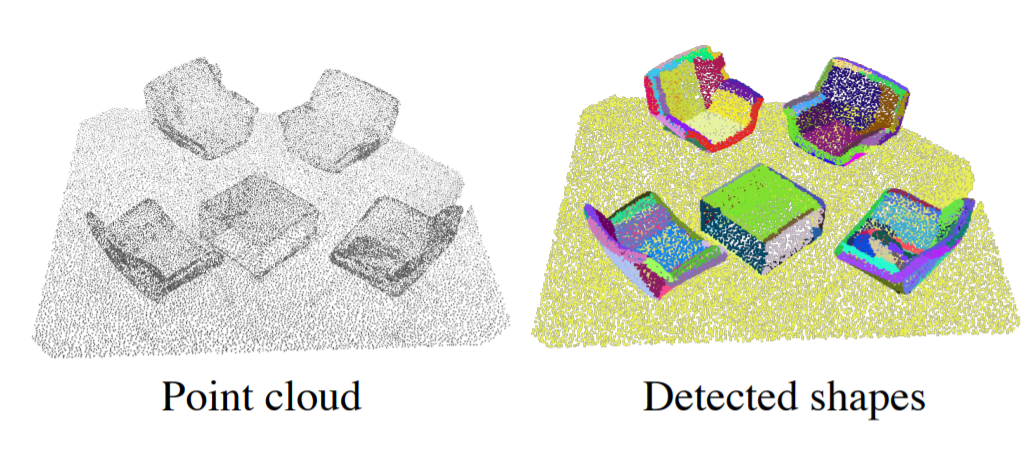

(映维网 2021年05月24日)在计算机视觉中,理解场景中的对象及其位置是一项标准任务。训练三维空间识别系统通常涉及使用传感器捕捉场景,然后用3D box手动标记场景中对象的空间范围,包括标记它们的位置。尽管人工标注是训练人工智能模型的一种流行且强大的方法,但它非常耗时。在一个小型室内3D场景中,标注和绘制box平均需要20多分钟。如果没有box,而有场景级别标签的集合(如场景中存在的对象列表),为三维场景添加标签会更快更容易。

所以,Facebook人工智能研究院和伊利诺伊大学厄巴纳-香槟分校的研究人员提出,不用空间标注的3D来进行空间识别。

在名为《Recognizing 3D spaces without spatial labels》的论文中,团队主要提出了以下问题:是否可以学习在训练期间仅使用场景级标记(如场景中存在的对象列表)作为监督,然后在三维数据(如点云)中执行空间识别呢,如检测和分割对象?

......(全文 1272 字,剩余 943 字)

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

映维网会员可直接登入网站阅读

PICO员工可联系映维网免费获取权限