腾讯优图+复旦大学提出SVP框架:基于风格增强的生动说话人头视频生成

说话人头生成

(映维网Nweon 2025年02月12日)说话人头生成THG (Talking Head Generation)是一项重要而富有挑战性的任务,它主要由音频驱动,并在虚拟现实和电影制作等各个领域都有广泛的应用前景。尽管基于扩散模型的THG方法提供了高质量和稳定的内容生成,但它们往往忽略了包含个性化特征(如说话习惯和面部表情)的内在风格。所以生成的视频内容缺乏多样性和生动性,在现实生活场景中受到限制。

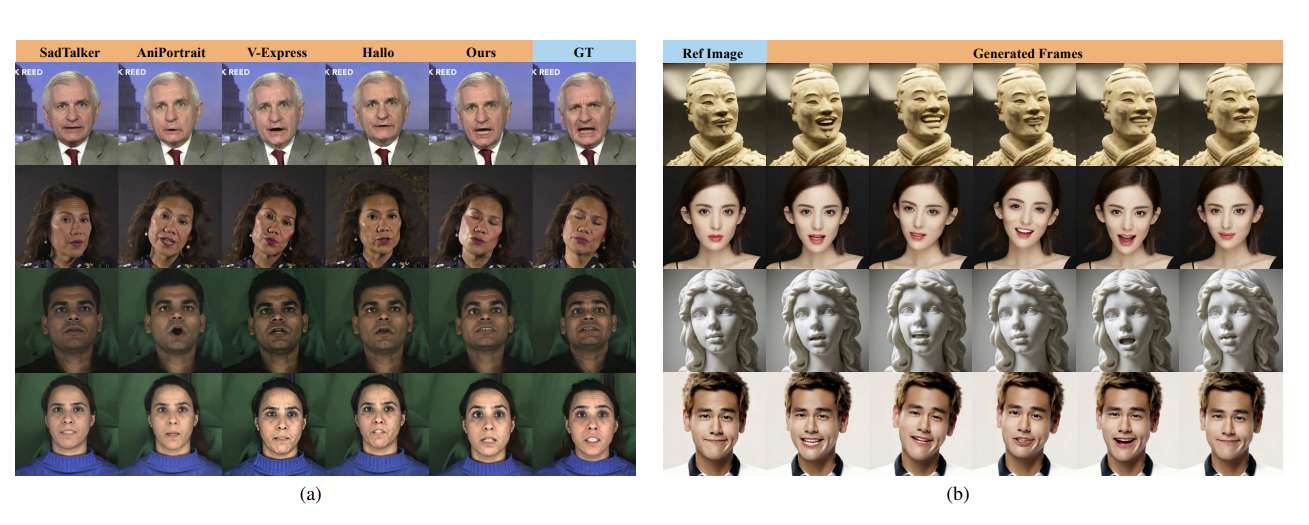

为了解决所述问题,复旦大学和腾讯团队提出了一种新的框架Style-Enhanced Vivid Portrait (SVP)。具体来说,研究人员首先引入了新的概率风格先验学习,利用面部表情和音频嵌入将内在风格建模为高斯分布。通过“定制”对比目标学习分布,有效捕获每个视频中的动态风格信息。

然后,对一个预训练的稳定扩散(SD)模型进行微调,通过交叉注意注入学习到的固有风格作为控制信号。实验表明,模型可以生成多样、生动、高质量的视频,并且可以灵活地控制内在风格,优于现有的最先进的方法。

......(全文 1773 字,剩余 1412 字)

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

映维网会员可直接登入网站阅读

PICO员工可联系映维网免费获取权限