英国皇家艺术学院介绍基于GenAI的触觉交互,将任何物理对象转换为自适应触觉界面

将任何物理对象转换为自适应触觉界面

(映维网Nweon 2024年12月12日)混合现实旨在融合数字世界和物理世界,创造身临其境的人机交互。尽管取得了显著的进步,但缺乏真实的触觉反馈往往会造成视觉和触觉感知之间的脱节,从而破坏沉浸式体验。

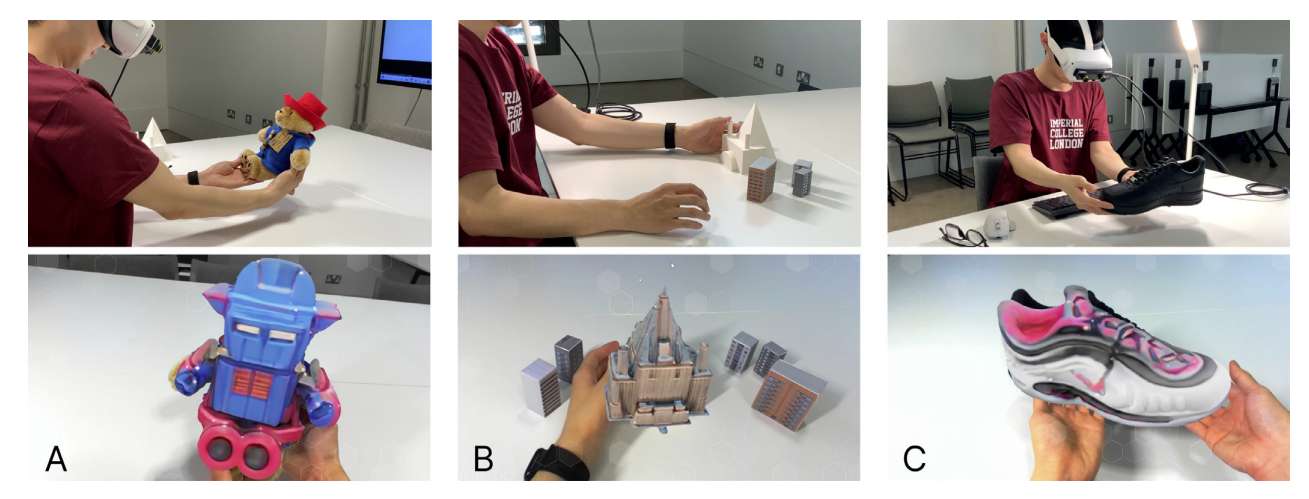

在一项研究中,英国皇家艺术学院团队介绍了基于GenAI的触觉再利用,通过将任何物理对象转换为人工智能生成虚拟asset的自适应触觉界面。利用最先进的生成式人工智能模型,系统捕获物理对象的2D和3D特征,并通过用户导向的提示来生成相应的虚拟对象,并保持原始对象的物理形式。

通过基于模型的对象追踪,系统实时动态地将虚拟asset锚定到物理道具,使对象可视地变形为任何用户指定的虚拟对象。研究人员表示,希望这项研究可以为进一步研究人工智能驱动的沉浸式和触觉技术的空间转换奠定基础。

......(全文 1426 字,剩余 1105 字)

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

映维网会员可直接登入网站阅读

PICO员工可联系映维网免费获取权限