清华和中科大为智能眼镜面部捕捉提出低功耗解决方案AUGlasses

一副配备了三个低功耗惯性测量单元的智能眼镜,可用于精确的面部重建

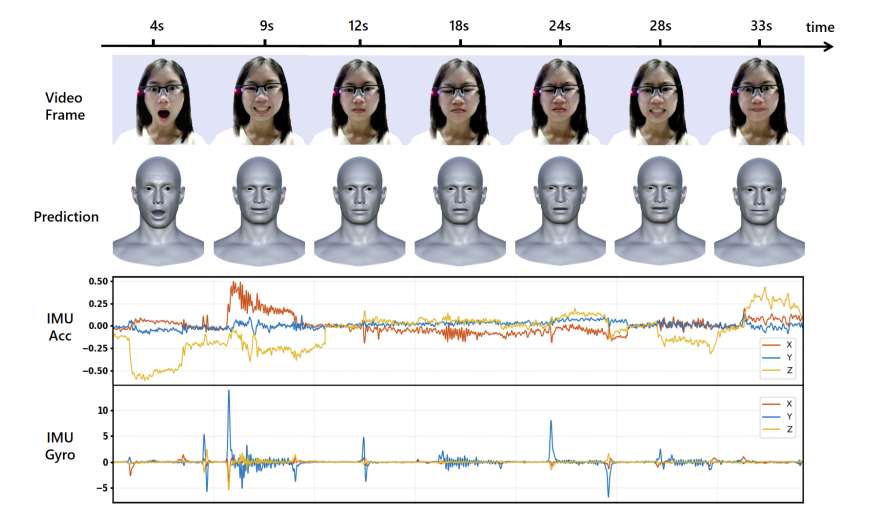

(映维网Nweon 2024年11月11日)智能眼镜的尺寸和功率限制需要一个微型和低功耗的传感解决方案。针对这个问题,中国科学院大学和清华大学的研究人员提出了AUGlasses。它通过在面部颞区放置惯性测量单元(IMU)来捕获由面部肌肉运动引起的皮肤变形,从而实现不显眼的低功耗面部重建。

IMU信号以及面部动作单元(AUs)的历史数据由基于transformer的深度学习模型处理,以实时估计AU强度,然后用于面部重建。

结果表明,AUGlasses准确地预测了14个关键AU的强度(0-5级),跨用户平均绝对误差(MAE)为0.187(STD=0.025),并实现了跨用户MAE为1.93mm(STD=0.353)的面部重建。团队同时集成了各种预处理和训练技术,以确保连续传感的稳健性能。微观基准测试表明,系统始终如一地使用微调的跨用户模型进行精确的连续面部重建,并实现了0.35的AU MAE。

......(全文 1682 字,剩余 1361 字)

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

映维网会员可直接登入网站阅读

PICO员工可联系映维网免费获取权限