NeRFs最佳用例,BBC介绍用2D手机图像创建惊艳3D视频

BBC的NeRFs最佳用例

(映维网Nweon 2024年02月19日)由于能够呈现高保真度的新视图,神经辐射场(NeRFs)在3D计算机视觉和计算机图形学中获得了极大的关注。

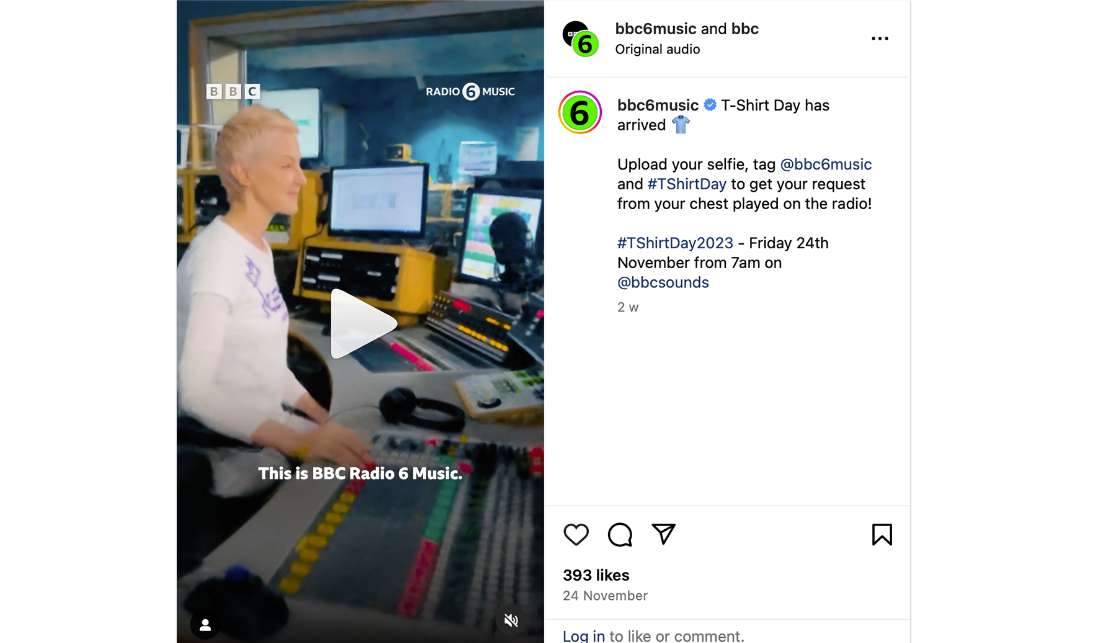

日前,BBC Research & Development的视觉计算团队与BBC 6 Music音乐频道合作,使用NeRFs技术来支持年度的T恤日活动(粉丝可以穿上自己最喜欢的乐队T恤并点歌)。在一篇博文中,他们撰文介绍了如何用2D智能手机图像创建令人印象深刻的3D视频:

我们的任务是为社交媒体制作简短而引人注目的视频,以传达用T恤来点歌的概念。为了展示音乐的感觉,我们想创造动态的,甚至有点超现实的元素。我们决定创造流畅的移动镜头,以传达歌曲到达听众的旅程。

因为工作室往往是相对较小的空间,我们通常不会为广播制作复杂的移动镜头,所以我们认为这可能是NeRFs的最佳用例。

NeRFs这种神经网络可以表示真实的生活场景,并允许我们非常自由地在场景中移动。它们使用一组来自环境的2D图像进行训练,而一旦处理,我们就可以制作新的视觉路径(或移动镜头)。NeRFs并不新鲜,我们从2020年开始就一直在研究它们,但新视图合成算法的最新进展意味着输出的质量和我们创建NeRFs的速度都得到了极大的提高。我们期待这项技术继续快速发展,但我们非常好奇我们现在是否已经能够创造出可用的内容。

它们在展示冻结的“时刻”和穿越相关空间的旅程之间提供了一条有趣的路线,而我们在制作每个视频时都学到了关于捕获或处理NeRFs过程的新知识。

我们制作NeRFs的指南

用自拍杆为我们的NeRFs拍摄视频

选择一个主题。镜头中的任何人在90秒内都不能移动(好不要眨眼)。

从各个角度录制拍摄对象和空间的视频,尽量不要投下阴影或产生任何反射(自拍杆可能会有帮助)。无论视频是水平的还是垂直的,都没关系,但一定要设置好你的相机,以避免运动模糊。不要移动太快。

用视频训练神经网络来重现场景。有几种不同的模型可以做到这一点,我们选择了结合了数个最近模型的元素来产生高质量渲染的Nerfacto。

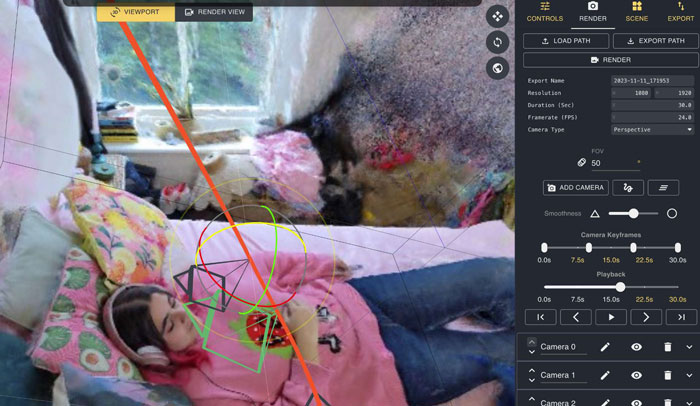

决定你想要通过场景导出的帧和动作。

查看生成的视频。

如果视频结果如你所愿,恭喜你,你现在可以将其放到编辑中。

但如果视频没有达到你想要的效果,要么重新导出不同的路径(相对快速和简单),要么重新训练你的神经网络(缓慢和烦人),或者甚至回去重新捕获视频(有时是最快的方法,但绝对令人讨厌)。

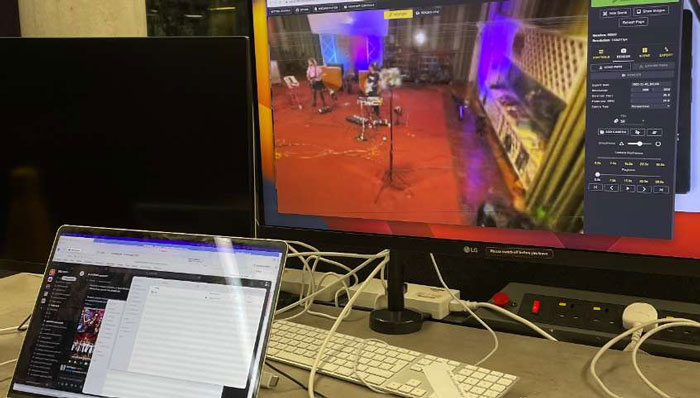

有人坐在桌子旁用电脑编辑拍摄的视频,桌上的记事本代表着视频中场景的空间。在记事本上写下乐队成员在现场的位置。

每个视频需要几分钟来拍摄,最多一个小时来处理,大约9个小时来训练网络,半小时来选择我们的路径,大约4个小时来导出一个可用的最终视频。正如有人指出的一样,这个过程很像冲洗一卷胶卷,你必须耐心等待它的结果。

我们决定将我们的视频导出为相当缓慢的空间旅程,这使得稍后在视频编辑器中改变路径的速度变得更加容易。

我们的第一个NeRFs是玛丽·安妮·霍布斯(Mary Anne Hobbs),她非常耐心地帮助了我们。我们在工作室里放置了一个面板灯,以确保与背景相比可以捕获到最清晰的玛丽。我们不确定我们想要什么样的路径,所以我们全面地捕获了整个工作室,包括玛丽·安妮的背后,以及面对房间的各个方面,涵盖高低角度。所以,当从90秒的视频中提取时,大部分输入都不是玛丽·安,而是工作室和其中的所有细节。

这意味着神经网络有大量的视觉信息要存储,不仅是玛丽·安,还有房间的所有细节,并将它们呈现为几乎相同的质量。这让我们在选择最终的路径方面有了很大的灵活性,但我们的实际拍摄对象玛丽·安的分辨率低于通常通过编辑标准的分辨率。

我们从第一个实验中得出的结论是,在为NeRFs捕获数据之前,重要的是要了解你希望采用的路径。这包括你想要关注的内容以及你想要看到的视角范围,以便将网络的注意力集中在目标区域。

Maida Vale工作室是我们迄今为止工作过的最大的工作室,所以录制荷兰乐队Pip Blom带来了有趣的挑战。

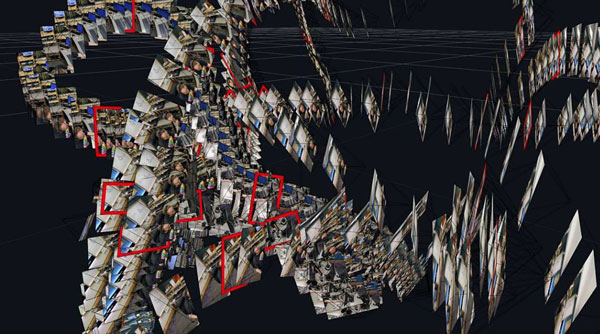

为了确保我们在编辑时有更多的选择,我们尝试了两种方法:一种是我们站在离乐队成员很近的地方,在很近的距离为他们每个人拍摄一个很短的视频;另一种方法以大角度范围拍摄整个乐队。

对于短距离视频,目标是避免拍摄对象的任何移动,从而防止模糊效果,并一次只关注一个乐队成员以捕获细节。这给了我们非常高质量的视频,但我们没有看到太多的工作室,并且会产生更多的剪辑。

对于一次性捕获整个工作室和乐队,这允许我们规划不间断的相机移动,但正如预期的那样,代价是任何一个部分的场景细节。这确实意味着我们可以尝试一些非常有趣的路径:

最终,我们选择了一个简单的视频:从一个高而远的有利位置推到主唱的特写,而这通常需要吊机或无人机。

我们想尝试让NeRFs“活起来”,并通过移动一个额外的手机摄像头到结束的地方,然后要求乐队“解冻”并播放歌曲。重要的是要确保NeRFs数据集中的最后一帧与视频的第一帧尽可能接近。我们在编辑中依然存在问题,从一个相对低分辨率的NeRFs到一个高分辨率的视频,所以我们添加了一个扭曲效果来软化两者之间的过渡。

有了上面的收获,我们和另一个音乐频道主持人休·史蒂芬斯(Huw Stephens)重复了这个过程。我们像以前一样设置了面板灯和自拍杆,但这次我们在拍摄时知道我们想看到休的脸,看到他的手放在音量控制键,看到他的T恤细节清晰,并从上面飞到麦克风上面。因此,我们将拍摄的焦点集中在他直接面对的角度,他脸部的特写,以及他头顶的角度。我们避免捕获背对他或在他背后的角度,而是依靠从休本人镜头中解除遮挡时渲染的背景。

由此产生的NeRFs更清晰,他的脸和T恤的分辨率同样高得多。我们依然可以展示NeRFs所具备的非物理路径,但可以集中在我们所捕获的休本人周围更紧凑的空间内。我们有效地优先考虑质量而不是数量,因为神经网络中的更多空间致力于与我们真正想在最终渲染中看到的场景所相关的细节,即休本人。

我们把上述经验运用到听众在家里和电车站的最后拍摄中。在一个小空间里捕获,而大部分都集中在对象身上。我们后来的NeRFs的质量明显更好。

为什么这些合作是有用的

作为一个研究部门,进行这种测试对我们来说非常有价值。这可以告诉我们当前的技术离行业实际应用还有多远,但同时允许我们能够加快对现有技术的理解、创新,并优先考虑我们认为最有用的开发工作。

例如,我们目前使用开源软件NeRFStudio规划镜头移动,这使得我们可以轻松访问许多当前最先进的NeRFs生产方法。然后,我们在非线性编辑器NLE中编辑导出的视频。

然而,思考在工作流程中如何最好地决定和控制NeRFs的路径将十分有趣。有一些集成允许在动画软件或虚拟制作技术中控制NeRFs,例如 Blender或Unreal。如果角度可以在NLE中进行控制,则编辑过程将会是什么样子呢,比如Adobe Premiere或Da Vinci Resolve?这是你可以看到创造性选择的点,所以将是令人难以置信的强大,因为它可以让我们重新制作一个镜头,使其与其他剪辑更好地配合,并迅速看到效果。

与其他制作同事合作有助于我们了解哪些创造性的可能性激发了编辑的最大兴趣,以及未来可能会发生什么。目前,制造移动NeRFs的处理成本令人望而却步,但这种情况可能会很快改变,而如果这种情况发生,我们将可以看到这项技术的诸多实际的和创造性用途。