Meta MR开发平台Presence Platform大更新,释放Quest Pro MR潜力

今天发布Quest Pro将能解锁全彩混合现实

(映维网Nweon 2022年10月12日)Meta在2021年的Connect大会亮相了Presence Platform。这个拥有大量机器感知和人工智能功能的工具集旨在帮助你构建逼真的混合现实、交互和语音体验,从而在用户的物理世界中无缝融合虚拟内容。对于今天发布Quest Pro,它将能解锁全彩混合现实,并为Presence Platform的核心堆栈引入一个新的支柱:社交临在。

1. 社交临在和Movement SDK

今天Meta发布了Presence Platform的最新补充Movement SDK。Movement SDK由眼睛追踪、面部追踪和三点身体追踪功能组成,而它们将有助于解锁全新的临场维度。Movement SDK允许Avatar使用Quest Pro的朝内传感器实时模拟面部动作。现在,开发者可以通过眼动追踪和面部追踪实现栩栩如生的Avatar,从而令虚拟角色可以看起来和感觉更像真人。值得一提的是,这是驱动Horizon Worlds和Holizon Workrooms中的Avatar的相同底层技术。

2. 眼动追踪和面部追踪功能

Movement SDK包括Quest Pro新开发的眼动追踪和面部追踪功能。头显内有五个指向面部的红外传感器:三个指向眼睛和上半脸,两个指向下半脸。面部追踪由机器学习模型驱动,可允许Quest Pro检测各种面部运动。

Movement SDK输出的抽象面部运动数据由基于面部动作编码系统Facial Action Coding System(FACS)的线性混合形状表示。FACS是一系列0到1的值,与一组通用面部运动相对应,例如皱眉。在将信号从Face Tracking API 映射到自己的角色rig时,开发者可以轻松保留用户原始动作的语义含义。

随着Movement SDK的引入,Meta现在能够支持第三方角色具现的社交临在。例如,团队创建了一个称之为Aura的外星人角色。她可以眨眼,左右移动嘴巴等等。

正如你在上面视频所示,Aura的面部和眼部动作可用于社交活动,并展示了机器学习驱动的高分辨率角色的潜力。Aura将于本月中下旬作为可下载示例托管至GitHub。你可以自由查看幕后情况,看看Meta是如何实现重定目标和rig映射。届时可注意相关的文档,它将为映射到不同的具体角色提供指导和最佳实践。

除了社交临在之外,开发者同时可以估计某人在VR中的视线作为输入,从而构建全新的交互和体验,类似于手动追踪。这意味着人们可以根据自己的视线所见来与虚拟内容进行交互。

Meta表示,他们从一开始就把隐私问题纳入了考虑范围。应用程序永远无法通过所述功能访问用户眼睛和脸的原始图像数据(或图片),它们只能通过一组数字来估计人们在VR中的注视位置和面部运动。开发者和Meta无法访问人们的眼睛和面部图像,因为它们在处理后会被删除,并且永远不会离开头显本地。

这家公司表示:“我们非常期待开发者使用眼动追踪和面部追踪来提高VR社交体验的创造性方法。”

3. Body Tracking API

Movement SDK同时包括Body Tracking API,后者可根据控制器或手相对于头显的位置来使用三点追踪。肢体语言是社交体验的一个重要组成环节。若看到角色的身体动作不符合人类实际,这将会完全打破沉浸感。所以,Meta使用了大量真实人体运动数据集来学习和纠正简单反向运动学(IK)方法常见的错误。

Body Tracking API可以在玩家使用控制器或仅使用裸手的情况下工作,并且在这两种情况下都提供了完整的模拟上身骨骼。它同时可以自动处理玩家放下控制器并开始使用裸手的情况,无需开发者进行任何额外的逻辑处理。

Body Tracking API适用于Quest Pro和 Quest2,并会支持未来的Meta Quess设备。另外,未来几年的Body Tracking API优化将通过相同的API实现,因此你将能继续从Meta获得最佳的身体追踪技术,无需切换到不同的界面。

Movement SDK现在已经可用,所以你可以马上开始构建利用所述新功能的应用程序。

4. 混合现实与场景理解、全彩透视和Shared Spatial Anchors

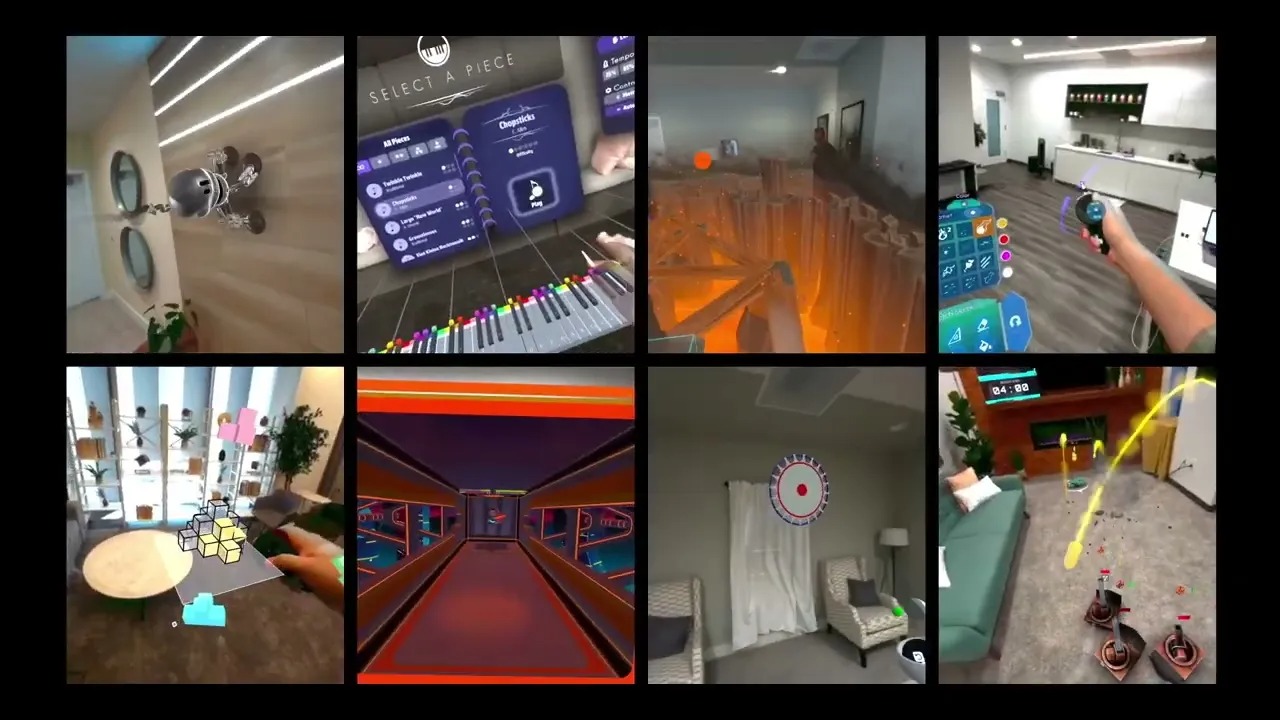

Meta早前已经发布了场景理解功能,并分享了混合现实和Presence Platform的可能性,包括Quest 2和Quest Pro。

使用Presence Platform的混合现实功能,Arkio正在带来一种更具沉浸感和影响力的体验,并且远远超出了平板屏幕的可能性。

场景理解功能允许开发人员创建适应用户个人空间的混合现实体验,并大大增加沉浸感。数字内容可以与物理世界交互,支持遮挡、碰撞和导航网格等等,而所有这一切都提高了混合现实中的沉浸感和真实感。

以Sir Aphino的以下场景为例,它展示了场景理解如何在虚拟角色、物理墙壁和天花板位置,以及玩家房间内的其他对象之间实现交互的基本示例。

下面是Meta今天发布的全新混合现实功能,它将帮助开发者以全新的方式融合物理世界和虚拟世界。

5. 全彩透视

Passthrough为用户提供了查看周围物理世界的方法,并允许开发人员构建将虚拟内容与物理世界混合的体验。自Passthrough推出以来,开发人员已经建立了一系列非常酷炫的早期体验。但是,过往的体验都是黑白,所以下一步的发展显然是全彩Passthrough。借助Quest Pro的先进传感器和4倍像素数,开发人员现在可以构建允许人们在参与虚拟世界的同时,又保持物理空间中完整、丰富的色彩的体验。Meta对高级立体视觉算法的投资提供了更高质量和更为舒适的Passthrough体验,在特写和房间规模混合现实场景中可以实现更好的深度感知和更少的视觉失真。

生产力应用程序可以将巨大的虚拟监视器与键盘和鼠标等物理工具相结合。对于Immersed,用户可以生成多达五个虚拟屏幕,在虚拟桌面上无干扰地工作或与他人协作。

利用全彩Passthrough,开发者现在可以进一步指出用户探索、体验和参与混合现实。最棒的是,使用Passthrough构建的 Quest 2应用程序支持Quest Pro。

6. Shared Spatial Anchors

Meta在2021年发布了允许开发人员在物理世界中锚定虚拟内容的Spatial Anchors。现在,Meta计划带来一个令人兴奋的升级版本:允许开发者构建本地多人游戏体验的Shared Spatial Anchors。

Shared Spatial Anchors允许开发人员为多个用户创建一个共享的锁定世界参考帧,从而构建本地多玩家(共同定位)体验。例如,开发人员可以构建两人或更多人可以在同一物理空间中协作或一起游玩,并与相同虚拟内容进行交互的游戏和应用。

在Connect大会,Meta展示了Magic Room的预览,这是他们为利用Shared Spatial Anchors的Horizon Workroom构建的混合现实体验。Magic Room允许任何形式的组合在共一空间协作,例如有人远程有人置身在物理空间。

7. 只是开始

Tribe XR、Painting VR、Wooorld和Figmin XR等应用背后的开发者只是少数几个已经通过Presence Platform为Quest平台开发应用的团队。

Meta表示,随着硬件的不断进步,Presence Platform将能创造更多的机会,并将混合现实、自然交互和社交临在带到VR,帮助我们朝实现元宇宙愿景继续迈进。