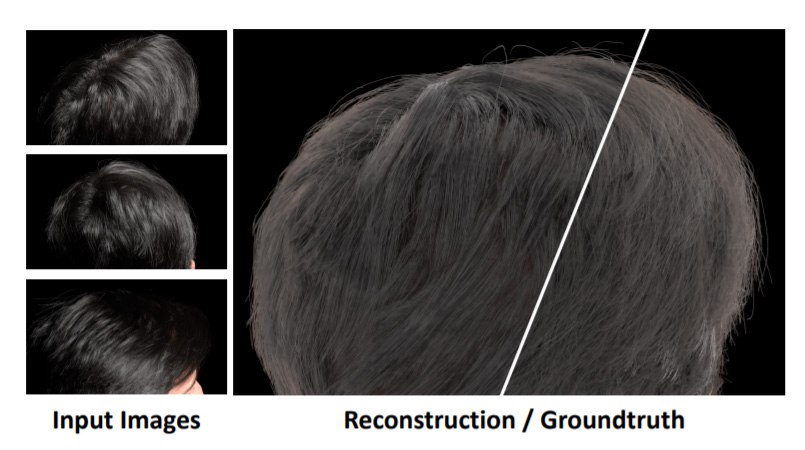

Facebook FRL提出逆向绘制重建,实现虚拟化身头发照片级真实感

帮助实现数字人类头发的照片级真实感绘制

(映维网 2021年08月16日)随着增强现实技术和虚拟现实技术的出现,创造逼真数字人类越来越受到计算机视觉和图形学界的重视。逆向绘制(Inverse rendering)是一种可以减轻3D美术建模高保真数字人类的工作量的广泛应用技术。对于数字人类逆向绘制,已经有数种成功的方法来构建产生多视点光度数据的捕获系统(多视点光度数据是从不同视点和不同光照条件下拍摄的一组图像)。对于所述图像,逆向绘制框架能够重建人体皮肤的详细几何结构和复杂材质外观,例如镜面反射和次表面散射。尽管以往的数字人类研究在人脸和身体方面取得了进步,但头发则不然。

由于本身的特点(微小尺度的几何结构和大量的发束,对高保真头发数据的逆向绘制依然是一个有待解决的问题。在名为《Human Hair Inverse Rendering using Multi-View Photometric data》中,Facebook Reality Labs和加州大学的研究人员提出了一个新的逆向绘制框架来重建头发的细节几何及其反射,从而帮助实现数字人类头发的照片级真实感绘制。

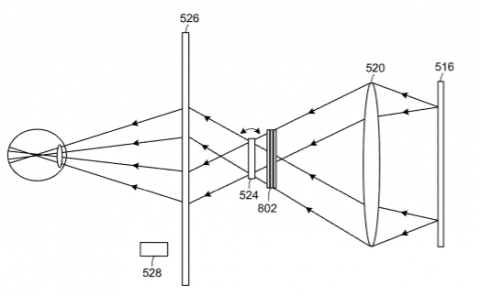

参考最近数字人类逆向绘制研究的成功,团队采用了多视图光度数据。作为第一阶段,研究人员以发束级别精度重建头发几何。传统的多视角立体技术在这个阶段失败,因为它们是设计用来重建三维表面,而不是三维发束。主要的挑战是在视图中寻找像素级的对应关系。有人曾提出一种基于线的多视图立体算法,亦即从多视图图像重建三维线云。然而,所述方法需要密集的摄像头(一个半球需要70个摄像头),并且依赖于启发式方法来匹配和选择视图。

......(全文 2156 字,剩余 1592 字)

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

映维网会员可直接登入网站阅读

PICO员工可联系映维网免费获取权限