对标Google Lens,Live Text和Visual Look Up将登陆iPhone

Live Text(实时文本)和Visual Look Up(视觉查找)

(映维网 2021年06月08日)谷歌的Google Lens已经成为最有用的增强现实应用之一。对于今天发布的iOS 15,苹果同样不甘人后。

延伸阅读:iOS15为苹果地图带来全新AR导航功能

这家公司宣布,Live Text(实时文本)和Visual Look Up(视觉查找)将登陆iPhone。可以说,这两个应用工具都是直接对标谷歌的Google Lens。

1. 将手写文本或打印文本转换为数字文本

Android手机用户已经相当熟悉,而现在iPhone用户同样可以便利地通过Live Text(实时文本)将手写文本或打印文本转换为数字文本。苹果指出,所述功能是基于采用机载处理的“深层神经网络”,而不是基于云计算的方法。

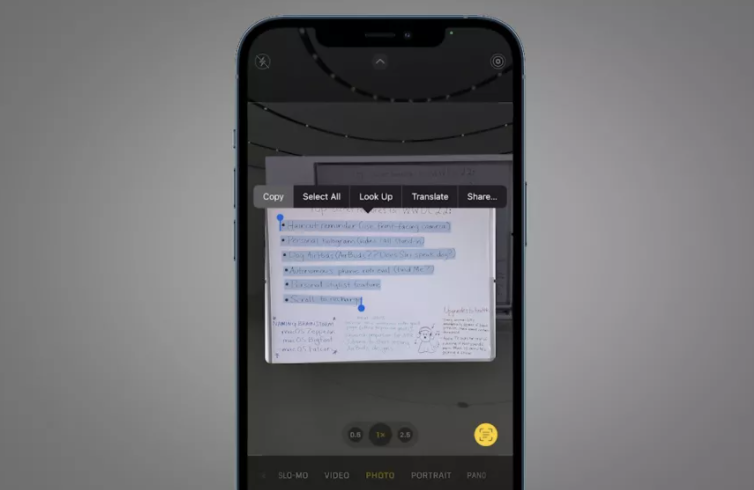

在一个演示示例中,你可以对准办公室白板的便笺,点击相机应用取景器右下角的新图标,然后扫使用常用的文本选择手势(将手指拖到文本)就可以将手写文本复制到电子邮件或便笺应用中。

你同时可以对图库中的现有照片使用Live Text(实时文本)。在一个演示示例中,苹果以数字方式复制了一张旧照片的餐厅名字和电话号码。

苹果的Live Text(实时文本)的局限性要大于Google Lens,毕竟后者从2017年就已经与大家见面。目前,苹果表示所述功能只支持7种语言(英语、中文、法语、意大利语、德语、西班牙语、葡萄牙语)。相比之下,Google Lens支持100多种语言。

尽管目前尚无法与Google Lens相提并论,但对于苹果的相机应用而言,这是一个相当有用的新功能,而且它适用于所有类型的照片,包括屏幕截图和网络照片。

2. 搜索真实世界

尽管苹果在WWDC 2021期间没有深入演示Visual Look Up(视觉查找),但这个功能可允许系统自动在照片中查找信息,比如狗狗的品种或者花朵的类型。

这家公司指出,所述功能适用于书籍、艺术、自然、宠物和地标,但具体的支持范围有待观察。考虑到搜索巨头谷歌能够从服务中收集到堆积如山的数据,所以苹果要想在这方面与其竞争,这无疑是一件棘手的事情。

不过,尽管这一功能在一开始可能存在限制,但这一举动或许是为传闻中的苹果眼镜铺路。自动识别视觉信息是任何智能眼镜的一个重要组成要素,而Visual Look Up(视觉查找)可以为日后的苹果眼镜奠定基础。

Visual Look Up(视觉查找)适用于iPhone、iPad和Mac。用户只需更新到最新的软件,你就能尝鲜使用。预计iOS 15的完整版本将在9月中旬左右推送。