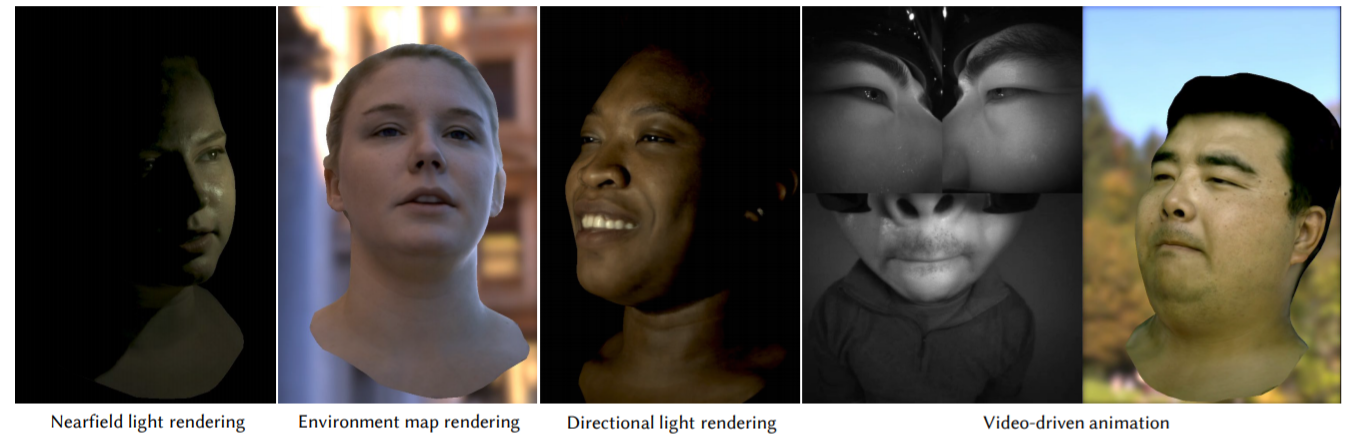

Facebook研究根据不同视点、光照动态渲染VR化身,让虚拟角色更逼真

对于游戏和电影制作,角色和环境之间的一致性至关重要

(映维网 2021年05月27日)近年来,虚拟化身创作在使用基于学习的技术方面有了显著的增长。传统的物理启发方法需要精确的几何结构和反射率,而这通常需要昂贵且耗时的手动处理。相比之下,基于学习的方法利用深度神经网络形式的通用函数逼近器来忠实地模拟人脸外观。它们可以通过完全自动化的管道来实现令人印象深刻的真实感,不依赖于对面部几何和材质属性的精确估计。它们同时能够在VR等要求苛刻的应用中实现实时生成和渲染。

尽管存在众多优点,但迄今为止,使用基于学习的技术来创建虚拟化身仅限于单一的照明条件。尽管在基于学习的再照明方面取得了很大进展,但现有的方法仅限于2D图像,它们不适合在新颖表情和光照条件下生成动态渲染。这种局限性阻碍了游戏和电影制作更广泛地采用基于学习的虚拟化身,因为对于游戏和电影制作,角色和环境之间的一致性至关重要。

如果大家有印象,谷歌曾在一份研究论文中探索过类似的再照明解决方案。名为The Relightables的系统实现了三项创新。首先,包含的摄像头是用作深度传感器,能够捕获对象的12.4MP深度图;然后,团队创建了能够从捕获的数据中合成视频的几何和机器学习重建管道;最后,系统能够捕获与深度图时间同步的反射比图,从而允许操作员在AR或VR场景中操纵对象的照明,不再是原始工作室的照明条件。

......(全文 1596 字,剩余 1070 字)

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

映维网会员可直接登入网站阅读

PICO员工可联系映维网免费获取权限