Facebook:超低摩擦输入,“腕带”是AR交互的未来

查看引用/信息源请点击:映维网

它同时需要一个足够舒适的形状参数,可以穿一整天,并且足够节能,可以长时间使用。

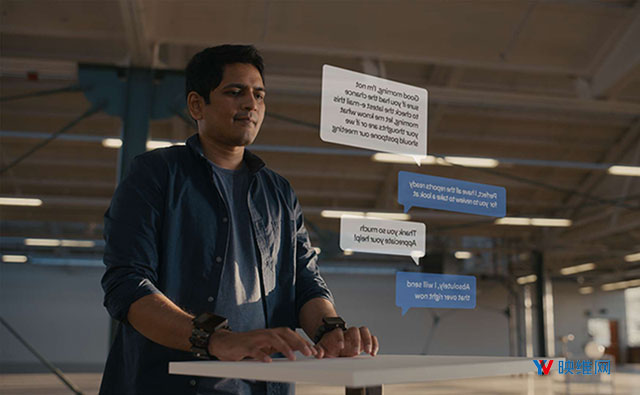

(映维网 2021年03月19日)Facebook Reality Labs(FRL)团队正在开发一种与AR眼镜进行自然直观交互的方式,因为其相信这将会改变我们与远近人们的联系方式。

AR眼镜不会像智能手机那样把我们的注意拉聚到手心周围,它能够看到我们双眼所看的世界。这是第一次把人放在计算体验的中心,并将数字世界以三维方式呈现给我们,帮助我们交流、导航、学习、分享和采取行动。

点击这里在哔哩哔哩查看本视频

人机交互(HCI)的未来需要一个易于使用、可靠和私密的界面,并允许我们能够始终完全置身于现实世界之中。要成为我们与数字世界交互的主要方式,这种界面需要大量的创新。最关键的两个要素是:能理解你的命令和动作,以及你周遭情境和环境的情景感知型人工智能;允许你轻松与系统沟通的技术(FRL将其称之为超低摩擦输入。在产品设计中,摩擦/Friction是指影响用户顺畅完成期望操作的障碍。用户完成期望操作的过程越快越简,摩擦度/摩擦点就越低/越少,可以理解为“无障碍交互”)。人工智能将根据对你及你周遭环境的理解,以及对你可能需要的信息或你可能想在各种环境下做的事情进行深入的推断,并且为你提供正确的选择。理想情况下,你只需点击一次就可以实现你想要的操作,或者更好的是,未来你甚至不需要做任何事情系统就可以执行正确的操作。Facebook的目标是允许你控制体验,即便事情是自动发生。

但这样一个系统需要多年的发展。日前,FRL通过博文分享了一个相关的迭代探索:包含有用但同时有限的情景型人工智能的腕带型输入设备,它将能够动态地适应你和你的环境。

下面是映维网的具体整理:

当FRL Research(前Oculus Research)成立时,团队就开始设想AR眼镜是理想的输入设备。我们(FRL Research)的目标是开发无处不在的输入技术:可用于一天中遇到的各种情况。最重要的一点,这个系统需要负责任地构建,从一开始就考虑隐私和安全,为人们提供有意义的方式来个性化和控制AR体验。界面同时需要直观、始终可用、不突兀和易于使用。理想情况下,它同时需要支持丰富的、高带宽的控制,适用于从操纵虚拟对象到编辑电子文档的所有操作。另外,它同时需要一个足够舒适的形状参数,可以穿一整天,并且足够节能,可以长时间使用。

这是一长串的要求。当我们探索相关的可能性时,有两点变得非常清楚:第一是,当时没有任何接近于所述标准的现有产品;另一点是,任何最终出现的解决方案都必须穿戴于手腕。

1. 为什么是手腕

为什么是手腕呢,因为存在其他同样有用的输入源。声音十分直观,但由于背景噪音的影响,它在公共领域不够私密或不够可靠。诸如智能手机或游戏控制器这样的独立设备则需要存储在口袋里,从而在你和你的环境之间增加了一层摩擦。当我们探索潜在的可能性时,在手腕放置一个输入设备成为了一个明确的答案:手腕常常用于佩戴手表,而我们已经对这一点已经非常习惯和熟悉。这意味着它可以合理地适应日常生活和社会环境。这是一个舒适的位置,适合全天穿戴。它就在你用来与世界交互的主要工具的周围:手。这种接近度将允许我们把丰富的AR控制能力带给你的双手,并实现直观,强大,令人满意的交互。

腕带型设备同时存在一个额外的优点:可以轻松地作为计算、电池和天线的平台,同时支持广泛的传感器阵列。缺失的一块拼图是寻找一条通向丰富输入的清晰路径,而一个潜在的理想解决方案是肌电图。

肌电图(EMG)利用传感器将通过手腕传递到前掌的电机神经信号转换成数字命令,并允许你用来控制设备的功能。所述信号可以允许你将清晰的一位元命令传达给设备。这是一种高度个性化的控制,可以适应多种情况。

通过手腕的信号非常清晰,肌电图可以理解手指仅一毫米的运动。这意味着输入可以不费吹灰之力,就像点击一个虚拟的、随时可用的按钮一样轻松,而且最终甚至可以感觉到大脑移动手指的意图。

于2019年随CRTL-Labs加入Facebook的FRL神经运动界面主管汤玛斯·里尔登(Thomas Reardon)表示:“我们尝试利用神经界面来支持你直接控制机器,利用负责手和手指肌肉的周围神经系统的输出,特别是脑外神经。”

你可以这样理解:你拍摄了大量的照片,但选择只分享其中的一部分。同样地,你会有大量的想法,但你只选择执行其中的一部分。当这种情况发生时,大脑会向手和手指发送信号,告诉它们以特定的方式运动,以便执行诸如打字和刷卡之类的动作。重点是在手腕位置解码所述信号(即你已经决定要执行的动作),并将它们转换为设备的数字命令。与你在手机屏幕点击选择歌曲、单击鼠标或在键盘上键入内容相比,这种根据意图来执行操作的方式会更为迅速。

2. 手腕的动态控制

在一开始,肌电图只提供一位元到两位元控制,我们称之为“点击”,它相当于点击一个按钮。这是基于动作的手势,比如拇指和食指的捏和放。走路、说话或就坐、双手放在身体两侧或口袋里,无论你在哪里或在做什么,捏放拇指和食指都非常容易执行。这样的操作永远可行,无需口言一字,从而使之成为第一个无处不在的超低摩擦AR交互方式。

但这只是第一步。肌电图最终将发展成更丰富的控制。在AR中,你将能够实际触碰和移动虚拟UI和虚拟对象,正如本文的演示视频一样。你同时可以控制远方的虚拟对象。这有点像是超能力,比如说《星球大战》中的原力。

点击这里在哔哩哔哩查看本视频

这只是个开始。最终,你非常有可能能利用肌电图直接在桌面或膝盖高速打字,而且速度甚至可能比键盘的速度更快。初步的研究非常具有前景。事实上,自2019年加入FRL以来,CTRL实验室团队在个性化模型方面取得了重要进展,并减少了训练适配个人打字速度和技术的定制键盘模型所需的时间。

点击这里在哔哩哔哩查看本视频

里尔登解释说:“神经界面的目标是改变人机交互的长久历史,并使之成为人类对机器具有更多控制权的开始,而不是反过来。我们需要的是以人为中心的计算体验。”

以QWERTY键盘为例。它已经有150多年的历史,而我们可以从根本上对其加以改进。请设想这样一个虚拟键盘:它可以随着时间的推移学习并适应你独特的打字风格,包括打字错误等。结果是键盘将慢慢地向你靠拢,与你合二为一,而不是与世间相同的物理键盘。这将比任何机械式打字界面都快,而且始终可用,因为你就是键盘。虚拟打字和点击等控件的美妙之处在于,我们已经能够熟练地使用它们。

3. 自适应界面和智能点击的路径

所以,在近期内有可能实现吗,而我们又将如何实现这一目标呢?

FRL科学研究总监赫尔沃耶·本克(Hrvoje Benko)表示。“我们相信,我们的腕戴型设备为AR眼镜通往超低摩擦的、始终可用的输入提供了一条路径,但它们本身并不是一个完整的解决方案,就像鼠标是图形用户界面的一部分一样。它们需要帮助进行意图预测和用户建模,以适应你和你的特定实时环境。”

如果系统不需要你点击菜单来选择目标操作,而是直接向你提供选项,然后你只需简单的“点击”手势就可以予以确认呢?当你把输入的微手势和一个自适应界面结合起来时,你就会得到我们所说的“智能点击”。

FRL研究科学经理谭雅·琼可儿(Tanya Jonker)解释道:“在未来,底层的人工智能或许可以理解你想做的事情。或许你出去慢跑,然后根据你过去的行为,系统会判断你非常有可能想边跑步边听歌。然后它就会在屏幕显示所述选项:“是否播放歌单?这就是自适应接口。然后你可以简单地通过一个微手势来确认或改变这个建议。智能点击允许你以非常低的摩擦方式来执行这种高情景相关的操作,因为界面会根据你的个人历史和选择呈现相关的内容,它允许你以最少的输入手势来完成操作。”

这可能只是在每次交互中为你节省几秒钟,但加起来就会非常可观。或许更为重要的是,微手势不会令你偏离自己的思路或行动。举例来说,当你在跑步或走路时,假如你不必停下脚步以选择和打开正确的应用程序,你会节省多少时间?AR眼镜要真正改善我们的生活,它就必须允许我们保持现状,无需停下。我们需要一个只有当数字信息相关时才会自然呈现出来,然后又自然消失在背景中的自适应界面。

琼可儿表示:“与其不断地把注意力转回特定的设备,界面应该在你需要的时候进入或离开焦点。它应该能够根据你的需要而调节自己的行为,向系统提供非常轻量级的反馈并解释建议的效用,以便整个系统随着时间的推移而改进。”

这是一项艰巨的任务,团队依然面临啊一系列的技术挑战。建立一个从用户和世界识别和解释情景的界面需要机器学习、人机交互和用户界面设计方面的进步。

琼可儿说道:“这个系统可以理解你的位置和关键对象,比如你的跑鞋,或者进行活动识别。它同时需要知道,在过去,你经常会在穿着跑鞋出门时启动音乐应用程序。然后,它会询问你是否要播放音乐,并允许你只需通过简单的单击即可确认。我们目前正在研究这种更为简单可行的示例。

4. 触觉聚焦

尽管超低摩擦输入(如手指点击或微手势)将允许我们与自适应界面进行交互,但我们同时需要一种方法来闭环反馈回路:允许系统与用户进行反馈,让虚拟对象感觉有形。这就是触觉发挥作用的地方。

FRL研究科学总监肖恩·凯勒(Sean Keller)指出:“从你出生时的第一次抓握物品,一直到灵巧地操作物理对象和在键盘打字,这都涉及一个非常丰富的反馈回路。你在这里用手和手指执行各种操作,然后你的手和手指会获得各种感觉。我们已经进化到利用这种触觉信号来理解世界。触觉允许我们使用工具和实现精细控制。从外科医生使用手术刀到钢琴家感受每一个琴键,这一切都取决于触觉。腕戴型设备只是开始。我们无法在虚拟世界中再现你与真实对象交互时所能感受到的每一种感觉,但我们已经开始越来越多地复刻其中的感觉。”

以虚拟拉弓为例。利用基于腕部的触觉,我们能够近似模拟向后拉弓的感觉,以便你确信自己正确地执行了相关的动作。

当你收到一封标为“紧急”的邮件时,你可能会感觉到一系列的震动和脉冲提醒,而正常的邮件可能只会提供一下下的脉冲或者根本没有触觉反馈。具体取决于你的喜好。当一个电话打进时,手腕的定制触觉反馈可允许你知道是谁在给你电话。在所述示例中,你就可以通过智能单击来执行接听电话或将其发送到语音信箱的操作,无需任何视觉反馈或只需很少的视觉反馈。这都是触觉反馈帮助人机交互成为你和你的设备之间的双向对话的例子。

FRL研究科学经理尼古拉斯·科隆尼斯(Nicholas Colonnese)补充说:“触觉同时可以传达不同的情绪。我们称之为触觉表情。如果你在正确的语境中,不同类型的触觉反馈可以对应流行的表情emoji。这可能是一种可以实现更佳社交的新奇又好玩的方式。”

我们目前正在建立一系列旨在帮助我们探索腕带触觉的研究原型。其中一个原型名为“Bellowband”。这是一种柔软轻便的腕带,因腕部周围放置的八个气动风箱而得名。它可以控制波纹管内的空气,使压力和振动在空间和时间方面呈现复杂的模式图案。这是一个早期的研究原型,并在帮助我们确定值得进一步探索的触觉反馈类型。

另一个原型Tasbi(Tactile and Squeeze Bracelet Interface)则采用了六个振触致动器和一个新颖的手腕挤压机制。利用Bellowband和Tasbi,我们测试了大量的虚拟交互,从观察用户是否能检测到虚拟按钮硬度的差异,到感受不同的纹理,再到移动虚拟对象。所述原型是帮助我们创造与现实对象和现实事件别无二致难的触觉反馈的重要一步。多亏了一种名为感官替代的生物现象,我们有可能实现所述目标:我们的大脑会将视觉、听觉和触觉刺激结合起来,并赋予虚拟体验全新的维度。

这只是早期阶段,但未来充满希望。

凯勒指出:“触觉研究令我们相信,我们实际上可以实现丰富的交流。人类可以通过触摸来学习语言,或许可能仅需一个腕带来实现。一个全新的空间刚刚开始向我们开放,而许多可能都是从手腕丰富的触觉系统开始。”

5. 充满无限可能的世界

利用手腕的传感器,你可以与虚拟对象交互,或者以几乎没有摩擦的方式控制客厅的周遭。天生残缺手部的人甚至可以学会操纵一只虚拟手部。

里尔登表示:“若只是将我们认为可能的事情作为根据,我们将会限制我们的创造力,以及我们在世界上的行动。能够做更多、做更快,从而实验更多、创造更多、探索更多,这是下一个计算平台的核心。”

我们相信人们不需要在虚拟世界和现实世界之间做出选择。通过基于手腕的超低摩擦输入、由情境感知AI支持的自适应接口和触觉反馈,我们可以以一种不会让我们脱离当下的方式来与设备进行通信,让我们与他人建立更深入的联系,并改善我们的生活。

凯勒说道:“这是一个不可思议的时刻,并为创新和发现创造了条件,因为这是旧世界的蜕变。这是对我们一直遵循和依赖的规则的改变,并将能推动计算向前发展。这是我现在能想象的最富有前景的机会之一。”