2020年12月30日新公布AR/VR科研论文摘选

文章相关引用及参考:映维网

一共更新了10篇论文

(映维网 2020年12月30日)近期各支科研团队公布了一批全新的AR/VR论文,下面映维网整理了来自大厂机构和学院的论文(详情请点击论文标题),一共10篇。更多论文披露请访问映维网专利板块https://paper.nweon.com/进行检索。你同时可以加入映维网AR/VR论文交流微信群(详见文末)。

1. 《SnapMove: Movement Projection Mapping in Virtual Reality(SnapMove:虚拟现实中的运动投影映射)》

团队:微软

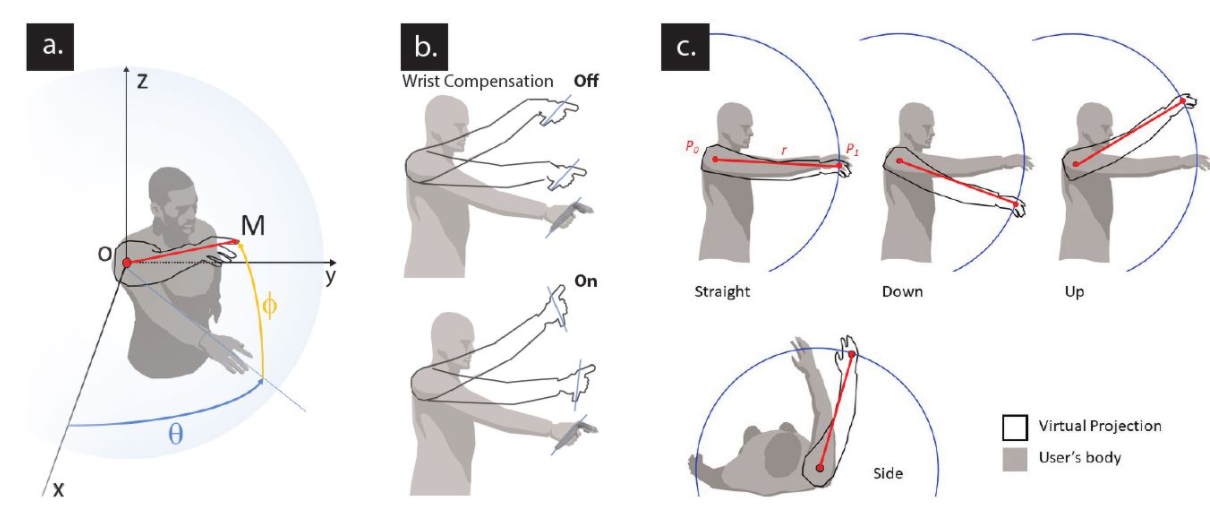

团队提出一个在虚拟现实中重新映射伸手动作的技术:SnapMove。SnapMove可用于减少对大规模、易疲劳或难以实现的动作的需求。团队设计了多种重投影技术,线性或平面,单手,双手或头部捕捉,而它们可用于伸手,投掷和虚拟工具操作。在一项用户研究(n=21)中,团队探讨了如何根据重新映射引入的运动成本来调节自我化身跟随者的效果。SnapMove成功地将手部位置从较低的区域重新投影到较高的手部位置,而这是限制疲劳的理想映射。它同时成功地保留了虚拟化身具现化,并逐渐允许用户执行更高能量成本的动作。这对于康复场景最为重要。团队实现了菜单交互、攀岩、划船和投掷飞镖的应用程序。总之,SnapMove可以使虚拟环境中的交互更加容易。团队讨论了SnapMove在游戏、可访问性和治疗方面的潜在影响。

2. 《Predictive Test Selection(预测性测试选择)》

......(全文 2963 字,剩余 2523 字)

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

映维网会员可直接登入网站阅读

PICO员工可联系映维网免费获取权限