密歇根大学提出HumanSplatHMR:人体姿态更准,渲染更真

姿态更准,渲染更真

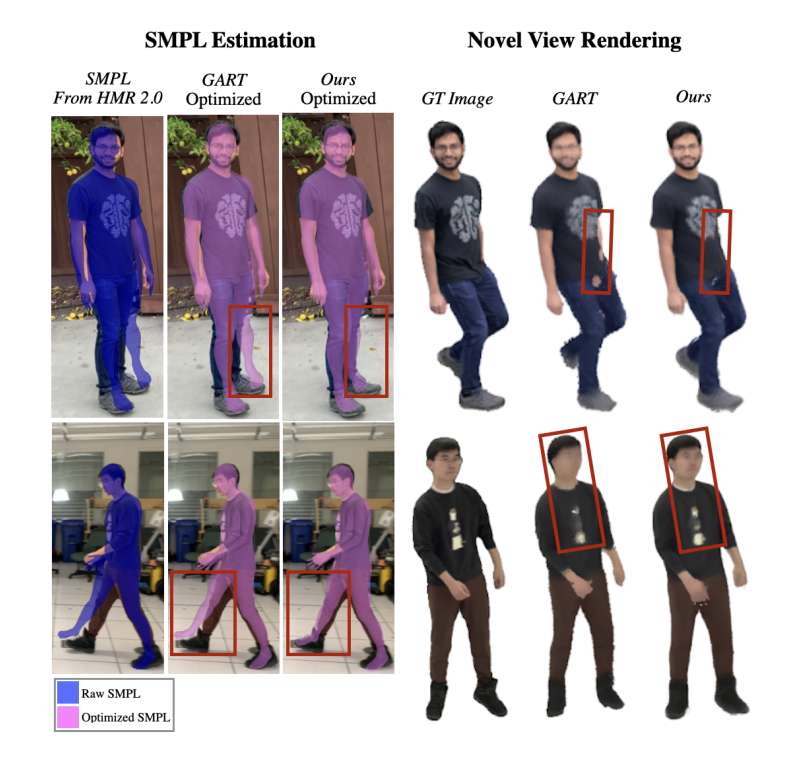

(映维网Nweon 2026年05月11日)密歇根大学的研究团队提出一种名为HumanSplatHMR的新型计算框架,可同时提升从视频中恢复人体三维姿态的精度和生成可动画虚拟化身的渲染质量。所述方法通过将人体网格重建与高斯飞溅渲染技术闭环耦合,在无需动捕设备或离线后处理的条件下,显著改善了对真实场景中人体运动的建模效果。

在计算机视觉与图形学领域,从单目视频中准确恢复人体姿态并构建逼真的可动画虚拟化身一直是重要挑战。现有方法通常将姿态估计与虚拟化身渲染分为两步,或者为了渲染质量而削弱姿态的几何约束,导致姿态误差放大,或者为了姿态精度而牺牲渲染的灵活性和真实感。

针对上述问题,密歇根大学的研究人员提出了HumanSplatHMR。这一解决方案以视频中每帧图像为输入,首先借助现有姿态估计模型(如HMR2.0)得到初始的人体网格(SMPL参数),然后通过可微渲染将渲染图像、深度图、人体分割与真实观测进行比较,并将误差反向传播至姿态参数与3DGS表示,实现两者的联合优化。

......(全文 742 字,剩余 360 字)

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

映维网会员可直接登入网站阅读

PICO员工可联系映维网免费获取权限