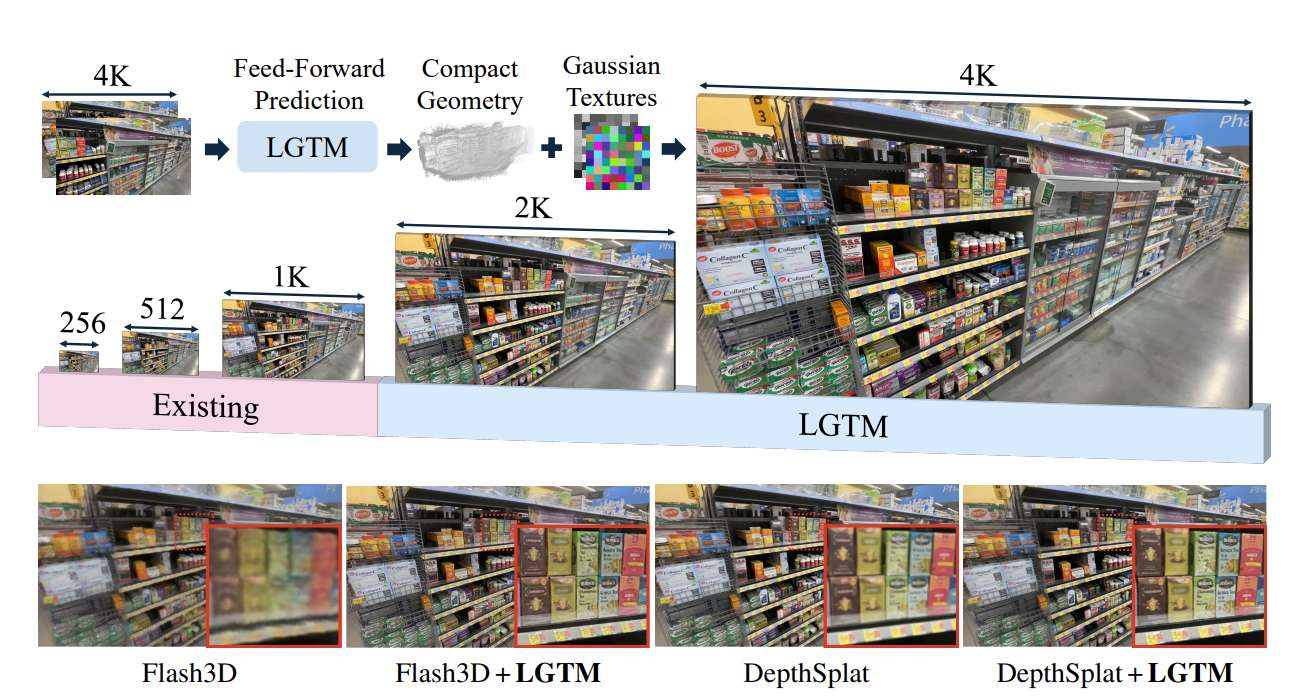

告别渲染瓶颈,苹果LGTM有望大幅提升Vision Pro图形性能

有望大幅提升Vision Pro图形性能

Vision Pro QQ群交流:653565822

(映维网Nweon 2026年04月04日)苹果和香港大学共同开发了一个能够高效实现高分辨率3D场景渲染的新框架,而所述技术有望大幅提升Apple Vision Pro的图形性能。

重建复杂场景并渲染高保真新视图是计算机视觉与图形学领域的一项核心挑战。应对这一挑战的系统需具备两大能力:

一是高效的前馈重建能力,以便模型能够即时重建新场景而无需额外的逐场景优化;

二是高分辨率渲染能力,以捕获精细细节并确保视觉保真度。

苹果指出,上述能力对于增强现实和虚拟现实这种对实时性与视觉质量要求苛刻的应用至关重要,会直接影响沉浸式用户体验。

......(全文 850 字,剩余 603 字)

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

映维网会员可直接登入网站阅读

PICO员工可联系映维网免费获取权限