PICO开发者亮相 StanfordXR Immerse the Bay 2025黑客松

StanfordXR Immerse the Bay 2025黑客松

(映维网Nweon 2026年01月16日)StanfordXR 的 Immerse the Bay Hackathon 已成长为全球规模最大、技术挑战性最高的 XR 开发者赛事之一。每一年,它都汇聚学生、独立开发者与初创团队,在真实硬件、真实压力、真实代码的条件下,快速打造下一代空间计算体验原型。

2025 年,PICO 参与其中,支持团队基于 WebSpatial 与 SecureMR 两个新兴平台进行开发——这两项技术致力于降低空间计算的开发门槛,同时提升能力上限。

在赛后的五周中,开发者们:

- 构建了可运行的混合现实应用

- 同时适配 Apple Vision Pro 与 PICO 4 Ultra

- 将项目代码开源

- 系统性地记录了架构设计

- 在 PICO 开发者平台支持下持续迭代,而非止步于 Demo

- 交付了可复现、可学习的完整项目

下面介绍的每一个团队,都因为一件在黑客松中极为罕见的事情而获得了 Ambassador(开发者大使) 身份:他们没有停留在演示层面,而是交付了真实、可扩展的开发成果。

本文将总结七个最具代表性的项目,并附上每个项目更深入的技术解读与 GitHub 仓库链接。

项目亮点

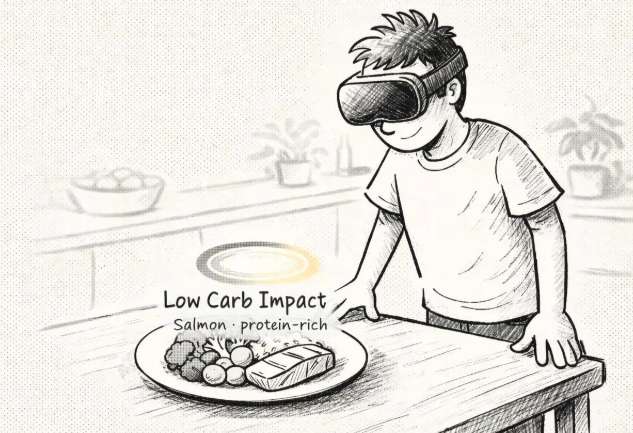

Glucose MR

隐私优先的实时混合现实营养指导

StanfordXR Immerse the Bay 2025: Best SecureMR App

Glucose MR 关注的是一个对延迟、信任与隐私都极端敏感的场景:糖尿病患者的日常饮食决策。

体验本身非常直接而有力:用户只需看向食物、输入血糖读数,系统便会即时在真实食物之上叠加营养与决策建议——包括碳水估算、糖分质量、营养结构等信息。全程无需云端处理,也不会上传任何原始相机画面。

在技术实现上,Glucose MR 结合了:

- 设备端基于 YOLO 模型的食物识别

- 来源于 USDA 的结构化营养数据库

- 针对糖尿病的决策逻辑

- 通过 SecureMR 架构级别强制隐私隔离的运行环境

- 所有推理均在设备本地完成,在不泄露图像或健康数据的前提下,实现亚秒级反馈。

为什么重要:

Glucose MR 证明了:本地 ML + MR 能够支持医疗等高敏感、高信任需求场景,同时不牺牲隐私与开发效率。

🔗 GitHub:https://github.com/erinmitt123/Glucose_MR

https://v.youku.com/v_show/id_XNjUyMDI2MzcxMg==.html

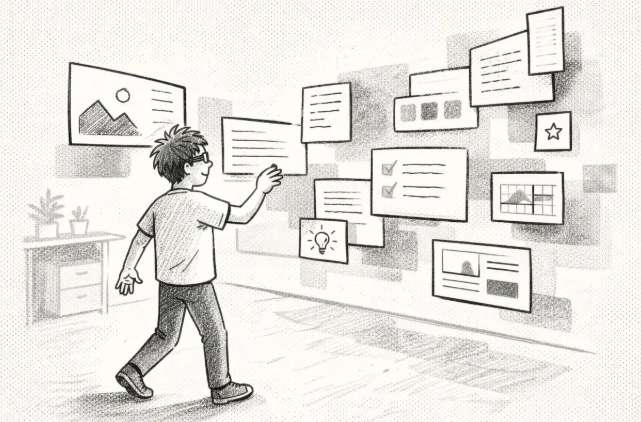

Spatial Canvas

将创作型工作空间重构为真正的 3D Web 环境

StanfordXR Immerse the Bay 2025: Best WebSpatial App

By Team Hoku (Utsav Gupta & Rebecca Neff, Filarion Inc.)

Spatial Canvas 提出了一个看似简单的问题:如果 Web 本身成为空间化工作台,会是什么样?

该项目完全基于 Web 技术构建,将熟悉的浏览器内容转化为具备深度感知的混合现实多面板环境。用户可以在真实空间中固定、排列并“走进”网页内容,把情绪板、研究资料和演示文档转化为空间物体。

关键技术亮点包括:

- 多场景布局与状态同步

- 基于 CSS 空间属性的分立的深度层实现

- 在 reducer 层完成的撤销 / 重做

- 完全客户端架构,无后端依赖

- 整个系统没有使用 Swift、RealityKit 或 VisionOS 原生代码。

为什么重要:

Spatial Canvas 展示了 WebSpatial 如何让开发者使用 React, TypeScript 和 CSS 进入空间计算,而无需推翻既有的 Web 开发者熟悉的技术栈。

🔗 GitHub:https://github.com/filarionforge/spatialcanvas/

https://v.youku.com/v_show/id_XNjUyMDI2MzcxNg==.html

SoulSpace

用空间叙事让情绪变得可感知

StanfordXR Immerse the Bay 2025: Best Overall Design & Storytelling

By Steve Kuo, Cheyoung Ahn, Pranjal Adhikari

SoulSpace 将日记从“滚动阅读”变成了“可行走的空间”。

用户不再只是记录情绪文字,而是将情绪历史可视化为一个三维空间景观。

你可以在其中探索情绪轨迹、查看 AI 生成的总结,并在一个安静、如玻璃般通透的混合现实环境中与自我反思互动。

技术上,SoulSpace 结合了:

- 完全客户端的 React 架构

- 用于记录、分析与探索的空间面板

- AI 辅助的情绪识别与反思生成

- 为舒适性与清晰度优化的轻量级 3D 表现

- 最终体验更像是一个私人空间,而非传统应用。

为什么重要:

SoulSpace 展示了空间计算如何让抽象的情绪与心理状态变得可见、可理解,却不压迫用户。

🔗 GitHub:https://github.com/cyoungie/soulspace

https://v.youku.com/v_show/id_XNjUxMTgzMDg4NA==.html

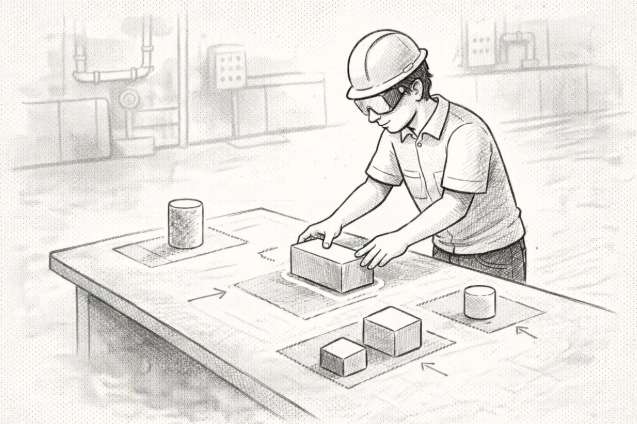

SecureFab XR

面向受监管制造业的隐私优先 MR 培训

SecureFab XR 面对的是一个现实而严苛的工业问题:许多工厂无法将摄像头数据上传云端,但依然需要实时、AI 驱动的培训系统。

该项目为高度监管环境设计,提供逐步、空间锚定的操作指导,同时通过 SecureMR 的安全运行时,从架构层面保证原始视觉数据永不离开设备。检测、验证与渲染全部在本地完成。

技术亮点包括:

- 基于 JSON 的培训流程描述

- 区域级空间验证

- SecureMR 内部的多管线 C++ 编排

- 清晰分离的视觉、逻辑与 Unity UI 层

为什么重要:

SecureFab XR 证明了:隐私优先并非限制,而是可扩展、可落地的工业 MR 路径。

🔗 GitHub:https://github.com/AarnavSan/SecureFabXR

https://v.youku.com/v_show/id_XNjUyMDI2MzcyNA==.html

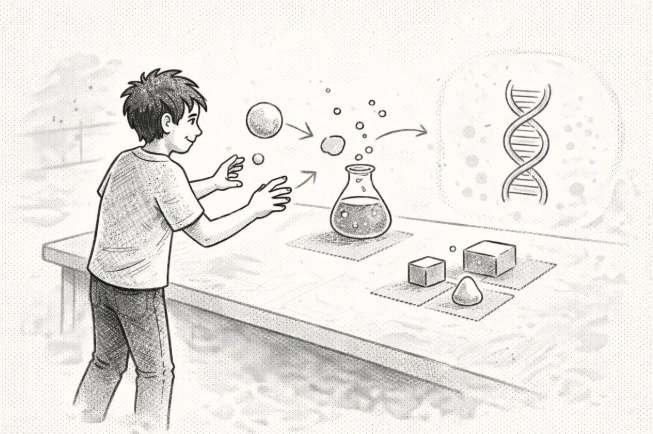

Genesis XR

通过实验学习科学,而不是死记结果

Genesis XR 让学习重新回到“实验”本身。用户可以组合虚拟材料、观察结果,并理解背后的真实科学过程,而不是被动记忆结论。

该项目基于轻量级 WebSpatial 架构,有以下几个亮点:

- UI 面板与 3D 内容的清晰分离

- 简单而聚焦的交互方式

- 本地持久化的探索记录

- 可访问性优先,而非视觉复杂度

为什么重要:

Genesis XR 展示了即使资源有限,空间计算依然可以支持探索式、体验式学习。

🔗 GitHub:https://github.com/j8swang/GenesisXRR

https://v.youku.com/v_show/id_XNjUyMDI2MzcyOA==.html

IdeaSpace

在 3D 空间中与 AI 一起脑暴“说出”想法

IdeaSpace 将 AI 视为共创者,而非工具。

用户自然地说话,想法会实时在 3D 空间中生成结构、形状与关系。

系统结合了:

- 语音优先的创作流程

- 在响应完成前即执行的流式 AI 行为

- 基于 WebSpatial 的空间画布

- 增量式 JSON 执行,带来“即时反馈”的感知

为什么重要:

IdeaSpace 展示了当 AI 与空间计算从设计之初就协同构建时,能达到的体验高度。

🔗 GitHub:https://github.com/a-khandel/IdeaSpace

https://v.youku.com/v_show/id_XNjUyMDI2MzczMg==.html

MindOrbit

为思维而存在的空间

MindOrbit 探索的是“以空间体验认知”的可能性。它不追踪任务、情绪或效率,而是将注意力、意识与心流本身可视化为围绕用户存在的空间现象。

用户站在一个安静的混合现实环境中心,抽象形态缓慢环绕、漂移、叠加。

体验更偏向观察,而非操作——鼓励觉察,而非量化。

项目强调:

- 认知与注意力的空间隐喻

- 非数据化、非分析式可视化

- 临在感优先于生产力

- 平静、冥想式的混合现实体验

为什么重要:

MindOrbit 提示了一种未来:空间计算可以支持觉察与内省,而不是一味优化与控制。

🔗 GitHub:https://github.com/aungbbo/MindOrbit

https://v.youku.com/v_show/id_XNjUyMDI2ODA3Ng==.html

真正交付的开发工作

这些项目之间并没有单一的应用场景,真正将它们连接在一起的是开发哲学。这些团队:

- 在真实约束下交付可运行的软件

- 开源代码

- 记录取舍与架构决策

- 在黑客松之后持续构建

- 获得了真实的空间应用交付经验

因此,他们获得 Ambassador 身份,并非因为奖项,而是因为把事情真正做完了。

下一步

如果你是对空间计算感兴趣的 Web 开发者,或是关注隐私优先 AI、本地 ML 的 XR 开发者,现在正是一个极为罕见的窗口期。

硬件已经就绪。

平台正在成熟。

而进入门槛,比以往任何时候都更低。

🔗 了解 WebSpatial:https://webspatial.dev

🔗 了解 SecureMR:https://developer-cn.picoxr.com/blog/introducing-securemr/

去探索这些项目。阅读深度解析。Fork 代码。

然后开始构建下一步吧。