中意研究团队提出RF-GS方法提升VR场景渲染稳定性

场景视图合成

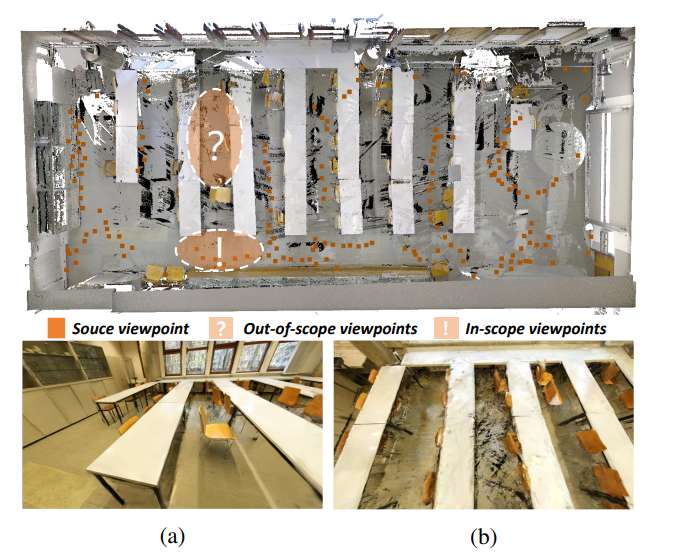

(映维网Nweon 2025年08月04日)场景视图合成,亦即从有限的角度生成新的视图,在虚拟现实和增强现实等应用中越来越重要。与基于对象的任务不同,场景视图合成处理整个环境。其中,不均匀的观察对稳定的渲染质量构成独特的挑战。为了解决这个问题,意大利米兰理工大学和中国科学院大学团队提出了一种新的方法:可渲染性场引导的高斯飞溅(RF-GS)。

所提出方法通过可渲染性域量化输入不均匀性,引导伪视图采样增强视觉一致性。为了保证宽基线伪视图的质量,研究人员训练了一个图像恢复模型,将点投影映射到可见光样式。另外,验证的混合数据优化策略有效地融合了伪视角和源视图纹理信息。模拟和真实数据的对比实验表明,所提出方法在渲染稳定性方面优于现有的方法。

渲染3D场景对于虚拟现实/混合现实应用至关重要。尽管目前的研究实现了高保真渲染,但对密集视图的依赖限制了它们的实际应用。神经辐射场(NeRF)通过神经辐射场表示实现高级目标重建。尽管随后的研究改进了其泛化能力,但NeRF的训练和渲染成本依然是一个限制。

......(全文 1815 字,剩余 1407 字)

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

映维网会员可直接登入网站阅读

PICO员工可联系映维网免费获取权限