蔚山科学技术院研发单摄像头双手交互3D重建技术

查看引用/信息源请点击:techxplore

即便物体是陌生的或部分模糊,系统都能实时重建复杂的手-物体动态

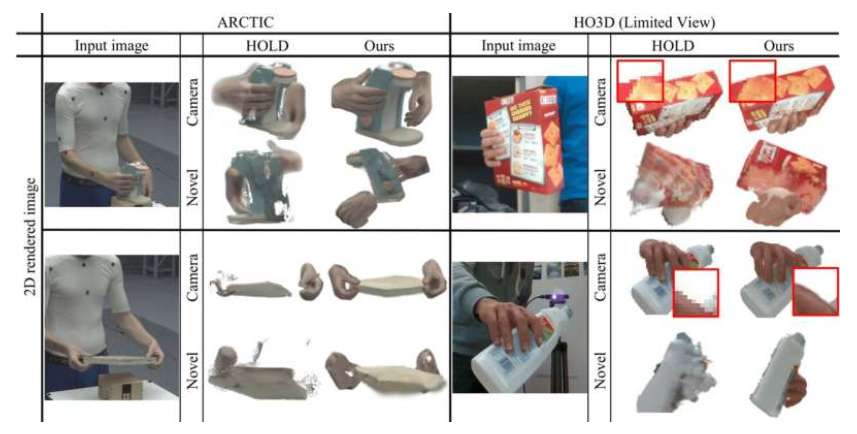

(映维网Nweon 2025年06月17日)蔚山科学技术院的研究人员日前介绍了一种双手交互3DGS。这种创新的人工智能模型可以用一个RGB视频输入来将手和对象之间的复杂交互可视化为3D,从而进一步增强实时交互能力。

即便物体是陌生的或部分模糊,系统都能实时重建复杂的手-物体动态。

这一领域的传统方法仅限于一次识别一只手或仅对预扫描对象做出响应,限制了它们在现实AR和VR环境中的适用性。

相比之下,团队的解决方案可以可靠地预测完整的物体和手形状,即便物体是陌生的或部分模糊,系统都能实时重建复杂的手-物体动态,不需要深度传感器或多个摄像头,而是仅仅依赖单个RGB摄像头。

这个AI模型的核心是基于3DGS,一种将物体形状表示为具有光滑高斯分布的点云的技术。与产生清晰边界的点云方法不同,3DGS能够自然重建接触面和复杂的相互作用。

......(全文 550 字,剩余 203 字)

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

映维网会员可直接登入网站阅读

PICO员工可联系映维网免费获取权限