VR触觉远程操控在无视觉输入下实现80%成功率物体抓取

整合触觉技术可用于支持以前单纯依赖于摄像头的远程操作任务,从而为未来更复杂的应用铺平道路

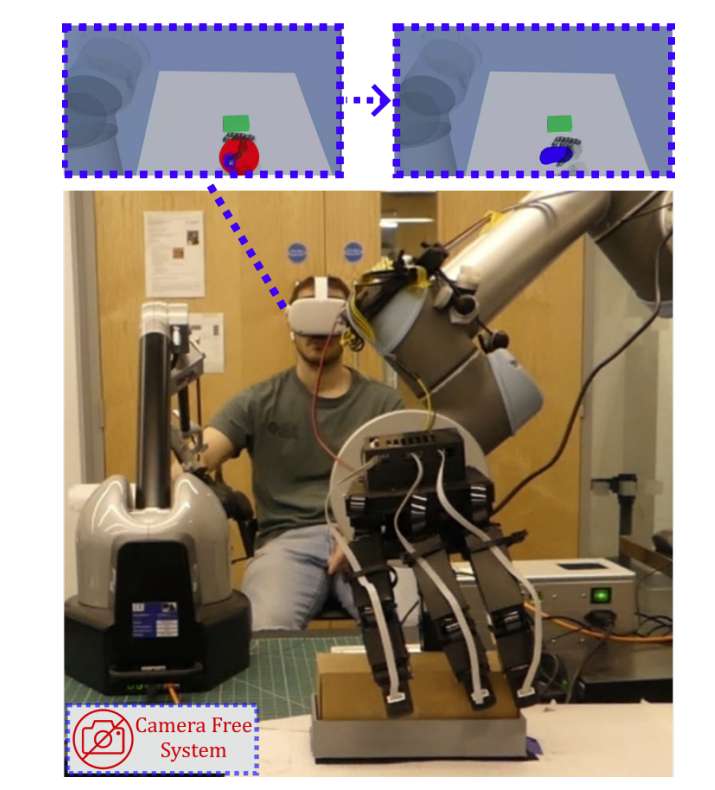

(映维网Nweon 2025年05月06日)基于VR头显的机器人远程操作正广泛地应用于一系列领域。在一项研究中,伦敦玛丽女王大学,Humanoid AI和伦敦国王学院团队利用VR头显和基于触觉的3D对象重建来向蒙眼用户提供触觉反馈,并证明了即便没有摄像头都能精确执行拾取和放置等远程操作。

初步结果表明,整合触觉技术可用于支持以前单纯依赖于摄像头的远程操作任务,从而为未来更复杂的应用铺平道路。

基于VR的机器人远程操作允许人类操作员远程控制机器人系统,并完成危险的或复杂的任务。另外,当前的机器人自主操作方面存在不足,而通过示范学习将人类技能转移到机器人是有用的。对于这一点,业界已经把目光投向VR虚拟现实。

......(全文 1443 字,剩余 1128 字)

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

映维网会员可直接登入网站阅读

PICO员工可联系映维网免费获取权限