韩国提出QORT-Former框架,实现AR/VR双手交互实时姿态分析

查看引用/信息源请点击:techxplore

仅使用108个查询和1个解码器(在RTX 3090TI GPU为53.5 FPS)就实现了实时姿态估计性能

(映维网Nweon 2025年04月07日)韩国蔚山科学技术院团队开发了一种全新的人工智能框架已经开发出来,为操纵物体的两只手提供了实时分析的新功能,并可以用于AR/VR。

业界在理解姿势和手物交互方面取得了重大进展。但增强现实和虚拟现实技术的出现提高了相关应用对实时性能的需求。然而,当前最先进的模型往往以大量的计算开销为代价。

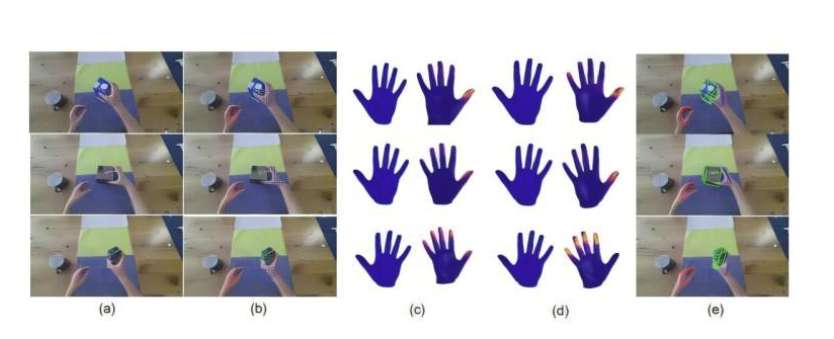

所以,韩国蔚山科学技术院团队提出了QORT-Former。这个查询优化的实时Transformer是一个基于Transformer的实时框架,主要用于手部和物体的三维姿态估计。

研究人员首先限制查询和解码器的数量以满足效率要求。鉴于查询和解码器的数量有限,他们建议优化作为Transformer解码器输入的查询,以确保更好的准确性:

请微信扫码通过小程序阅读完整文章或者

请微信扫码通过小程序阅读完整文章或者