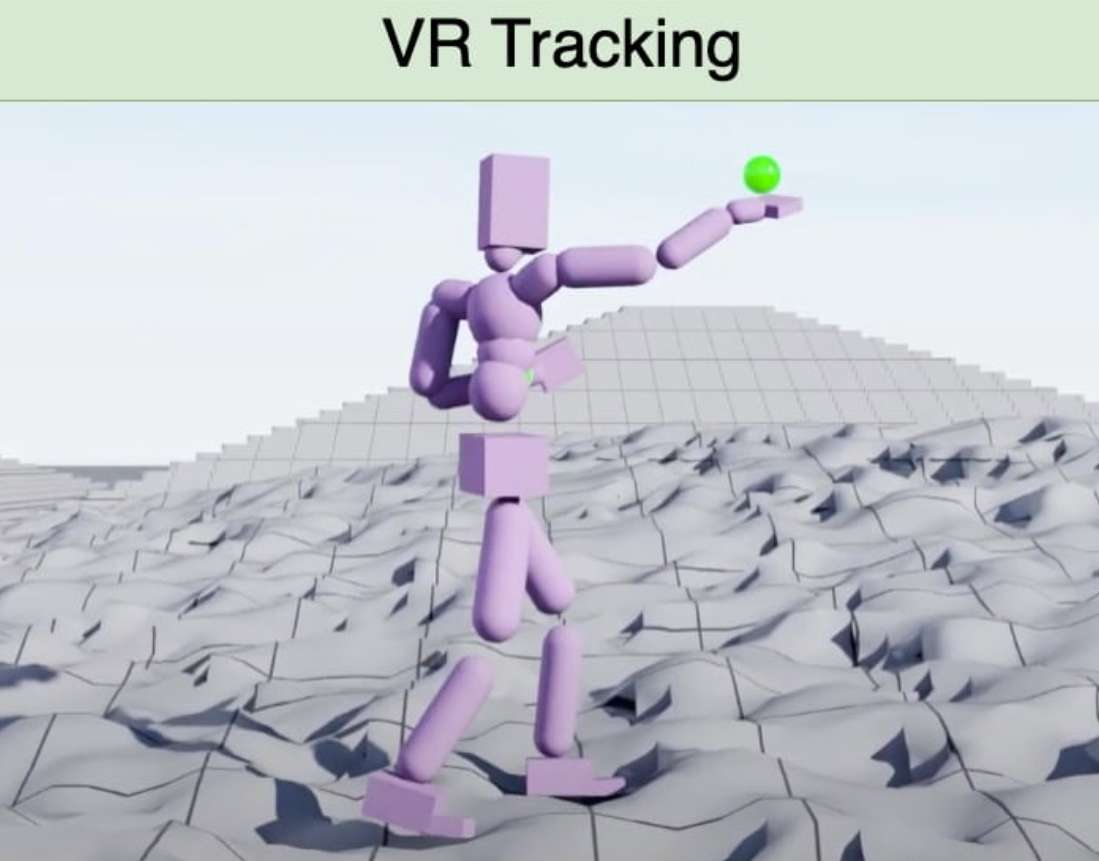

英伟达分享AI技术MaskedMimic,专用于AR/VR等生成虚拟角色动作

能够根据少量的信息来自动生成符合物理规律且适应动态复杂场景的完整角色动作

(映维网Nweon 2024年12月05日)由英伟达开发的AI技术MaskedMimic专门用于生成虚拟角色的动作。这一技术主要利用所谓的“掩码动作补全”(Masked Motion Inpainting),能够根据少量的信息来自动生成符合物理规律且适应动态复杂场景的完整角色动作。

换句话说,你可以只提供部分关节的位置,或者用一段文字描述需要的动作,然后系统就会自动推导出完整的、符合物理规律且适应动态复杂场景的角色行为。

MaskedMimic在多个领域具有广泛的应用潜力。以AR/VR为例,MaskedMimic只需头手传感器的数据即可生成全身运动。这意味诸如当前已提供头手追踪数据的头显都能帮助生成全身虚拟角色,无需额外的硬件。

在日前一篇博文中,英伟达专门发文介绍了MaskedMimic:

在计算机动画和机器人技术中,创造能够自然移动并对各种控制输入做出智能反应的交互式虚拟角色迄今都是最具挑战性的问题之一。尽管高性能并行模拟器(如NVIDIA Isaac Sim)在训练交互式类人机器人方面取得了重大进展,但目前的方法依然面临着根本性的限制。换句话说,它们需要专门的控制器来完成不同的任务。

......(全文 2105 字,剩余 1677 字)

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

映维网会员可直接登入网站阅读

PICO员工可联系映维网免费获取权限