Meta分享全身Avatar Demo《Dodge Arcade》,以及相应Unity、Unreal示例

提供了第一方的演示应用《Dodge Arcade》来展示IOBT和Generative Legs的效果

(映维网Nweon 2023年12月22日)Meta日前宣布正式发布用于为Quest 3绘制上半身的视觉追踪系统Inside-Out Body Tracking (IOBT),以及可以为所有Quest设备生成合理腿部运动的Generative Legs。通过结合所述两项功能,开发者将能够更轻松地创建全身Avatar。

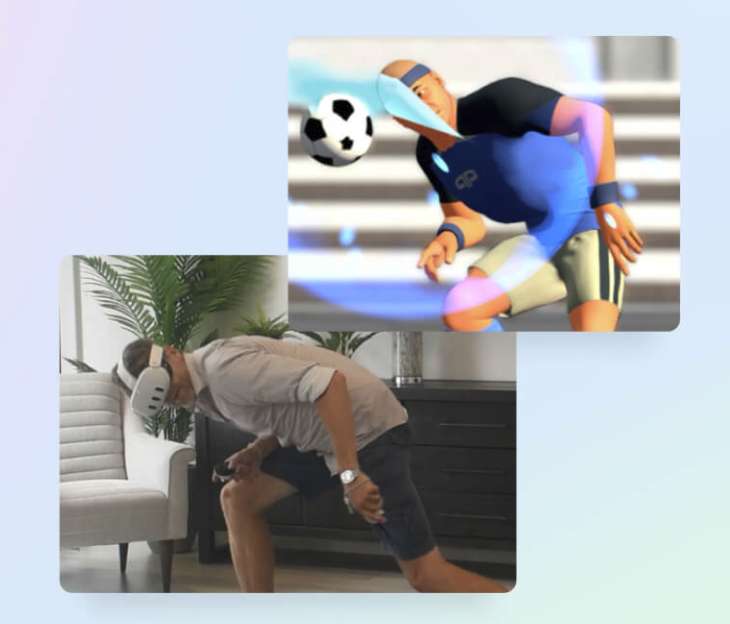

值得一提的是,Meta同时提供了第一方的演示应用《Dodge Arcade》,以及Unity和Unreal示例来展示IOBT和Generative Legs的效果。

所述两项功能现已通过v60可用,并将能帮助你为各种VR和MR体验构建更逼真的运动。

提高动作游戏和健身应用的运动精度

IOBT(仅支持Meta Quest 3)为开发者和用户提供了一个更准确和自然的身体追踪系统。系统现在可以准确地反映肘部、手腕和躯干的动作,从而为游戏和健身应用解锁了独特的价值,并帮助用户躲避物体或以正确的姿势锻炼。

Generative Legs(与所有Meta Quest设备兼容)则允许开发者在人工智能的帮助下整合自然的腿部运动,只需通过评估他们上半身的位置即可,不需要额外的硬件或传感器。现在,你不会再看到不是幽灵般的漂浮半身,而是能够与用户匹配对应的真实全身运动。

用更真实的身体动作增强社交存在感

使用所述的Movement SDK功能,你将能看到你的受众及其Avatar如何体验日常动作方面的进步,如站立、走动和与他人交谈。例如,《Drunkn Bar》的开发者就利用IOBT的追踪能力和Generative Legs的预测能力来构建出逼真的全身Avatar。

在实际应用中感受这两项技术的效果

为了展示IOBT和Generative Legs的效果,Meta创建并在App Lab提供了一个躲避球应用《Dodge Arcade》,这样你就可以体验到IOBT的追踪保真度是如何在Meta Quest 3实现。对于这款作品,你可以使用身体动作来躲避来袭的火球和阻挡足球。你同时可以蹲下、倾斜和跳跃来躲避球,另外,你的动作会在竞技场回放屏幕上反映出来。

我们迫不及待地想看看你会创造什么

对于v60,除了Unity的全身示例外,Meta同时发布了包括Unreal Metahuman和Mannequin-rigged角色的Unreal示例更新。另外,现在已经支持Unreal的标准组件导入动捕(Live Link),所以身体运动可以很容易地集成到Unreal的生产工作流程之中。

Movement SDK为你提供了开箱即用的动捕工作室工具,Meta表示非常期待看到你将如何把IOBT和Generative Legs结合起来, 并为受众构建令人兴奋和愉快的VR和MR体验。

更多信息请访问IOBT和Generative Legs的文档(Unity | Unreal)。