开发者展示苹果Vision Pro头显的手部追踪和遮挡性能

手部遮挡的效果非常好,但并不完美

(映维网Nweon 2023年12月21日)Vision Pro开发者日前发布了一段视频,并展示了所述苹果头显的手部追踪和遮挡性能水平。

有望在2024年1月正式发售的Vision Pro将使用手控作为主要的输入方法。尽管系统级交互结合了手+眼追踪,从而实现“看和点”的模式,但开发者可以构建允许用户直接使用双手与应用程序交互的应用程序。

Vision Pro的手部追踪可以分为两个不同的功能:“手部追踪”和“手部遮挡”。

手部追踪是手部、关节和指尖位置的估计3D模型。相关模型用于确定何时触摸、抓取和交互对象。

手部遮挡处理系统如何将你的真手覆盖到虚拟内容之上。Vision Pro不是在场景中绘制虚拟手的3D模型,而是将你的真手的图像剪切出来,在场景中显示出来。这样做为虚拟内容增加了另一层真实感,因为你可以看到自己独特的手。

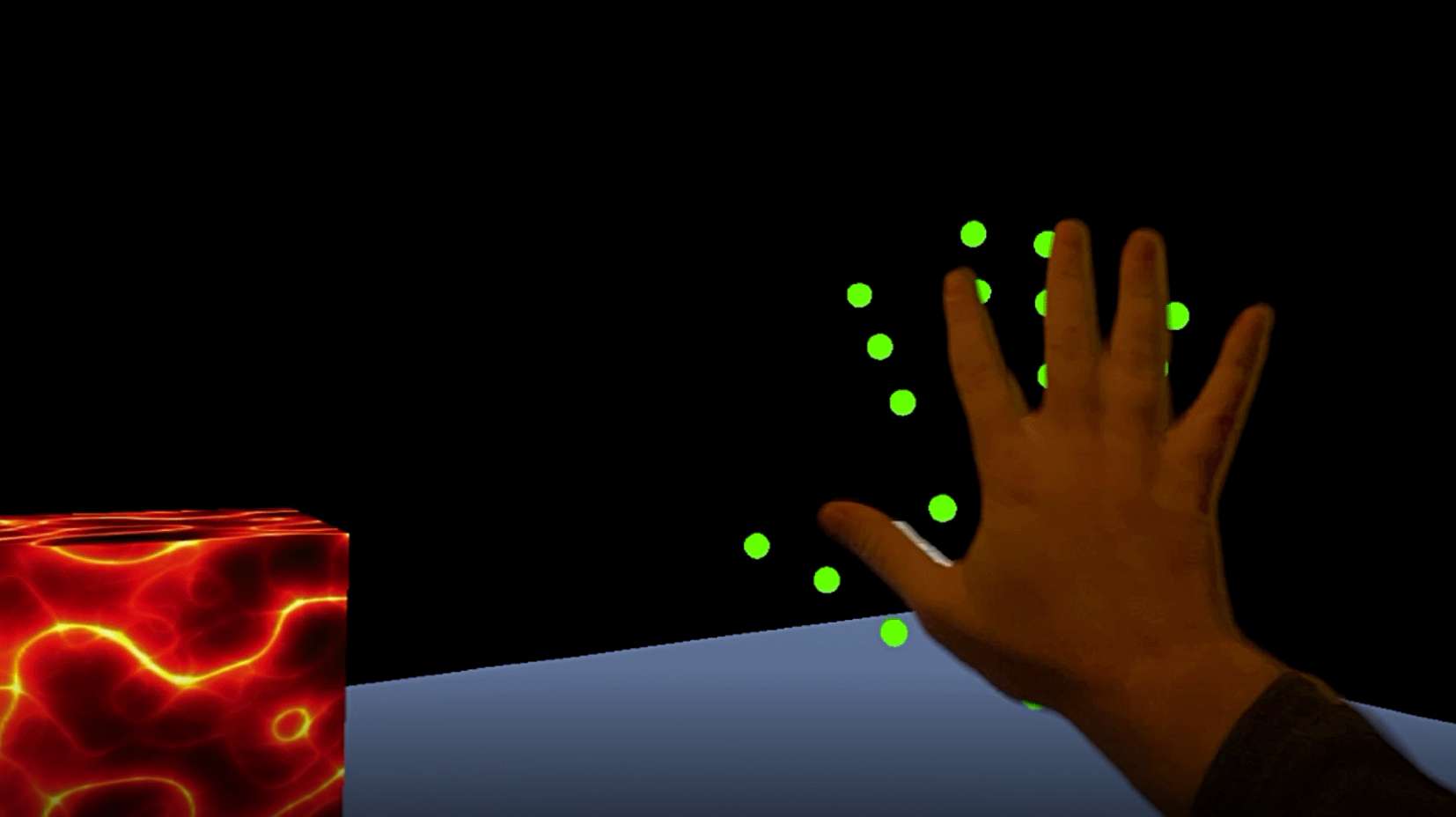

使用Unity开发Vision Pro的开发人员发布了一个视频,该视频清晰地展示了手部追踪和遮挡。

在上面的视频中,真手显示了遮挡系统的作用,而绿点显示了估计的手的3D位置。

我们可以看到,手部遮挡的效果非常好,但并不完美。当完全被虚拟内容包围并快速移动时,你可以看到手的边缘有一定的剪切伪影。

同时,实际的手部追踪位置远远落后于手部遮挡,大约落后100-200ms。然而,我们无法确定Vision Pro的手部追踪的真实延迟,因为我们只有一个视图来进行比较(它们本身相对于真手有一定的延迟)。

视频来自Unity开发者的对话,他们发现在Vision Pro的早期实验中显示出非常高的手部追踪延迟(与最新的Quest手部追踪功能相比)。其他Unity开发者表示同意,他们在自己的Vision Pro设备实验中看到了类似的延迟。

然而,问题视频是Unity应用内部的手动追踪集成,这意味着手动追踪性能和延迟可能存在其他与Unity相关的因素。考虑到头显尚未发售,而所述工具依然在开发中,我们应该会在设备亮相时看到更多的改进。