苹果专利分享了Vision Pro的手部追踪交互模式解决方案

用于用户手势检测的交互区域

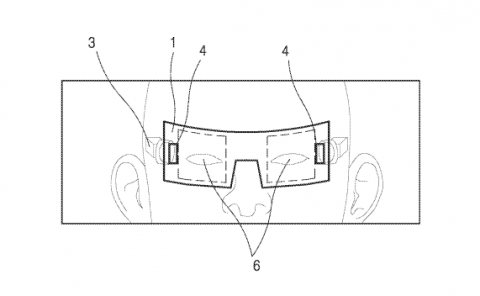

(映维网Nweon 2023年10月30日)对于苹果Vision Pro,手+眼控制是主要的交互模式。在名为“Hand engagement zone”的专利申请中,苹果介绍了一种改进的技术来管理执行手势的手部追踪。具体来说,发明描述了一个用于用户手势检测的交互区域,使得用户界面可以根据检测到用户的手势或手在交互区域内的动作进行修改。

通常,用户交互模型包括首先确定用户如何表达与UI交互的意图。在第二阶段,用户交互模型追踪用户如何与UI交互。在第三阶段,用户交互模型追踪用户如何表达脱离UI的意图。

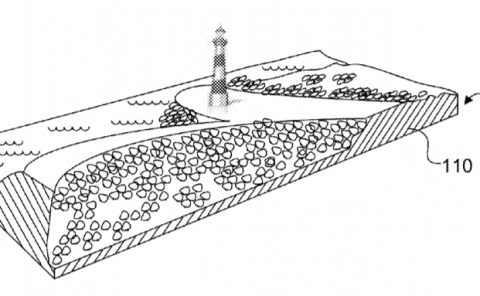

在一个实施例中,用户可以抬手来表达与UI交互的意图。例如,手部可以进入一个交互区域。在这个空间中,系统可以确定用户打算与UI进行交互。在这种交互状态下,系统可以追踪用户的动作,例如手或眼的运动,从而检测用户与UI的交互。然后,用户可以通过离开交互区域而脱离交互状态。

在一个实施例中,脱离状态同时可以基于检测到的手部休息姿势来触发。例如,如果用户的一只手或几只手依然在交互区域的边界之内,但停留在一个表面之上不动,则可以认为用户处于休息状态。

......(全文 2624 字,剩余 2207 字)

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

映维网会员可直接登入网站阅读

PICO员工可联系映维网免费获取权限