Meta AR/VR专利探索根据用户注视捕获图像

根据用户注视来捕获图像

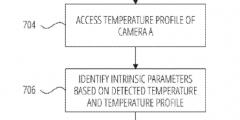

(映维网Nweon 2023年05月12日)随着眼动追踪正逐渐成为VR头显的标配,利用用户注视点的应用正在不断增加和优化。在名为“Gaze-guided image capture”的专利申请中,Meta就介绍了一种根据用户注视来捕获图像的方法。

在一种实现方式中,头戴式设备包括眼动追踪系统、第一图像传感器、第二图像传感器和处理逻辑。眼动追踪系统生成用户眼睛的注视方向。处理逻辑接收注视方向并在第一图像传感器和第二图像传感器之间进行选择以捕获注视引导的图像。例如,可以选择具有与注视方向相对应的FOV的图像传感器来捕获注视引导的图像。

在一个实施例中,基于用户的注视方向从一个或多个图像生成一个或更多个注视引导图像。生成注视引导图像包括对图像中的一个或多个进行数字裁剪。生成注视引导图像包括响应于注视方向旋转摄像头。

响应于注视方向生成注视引导图像允许用户捕获与他们注视/观看的位置相关的图像,而不需要额外的努力。另外,响应于用户的注视方向生成注视引导图像允许一个或多个摄像头捕获聚焦景深的图像。响应于眼动追踪系统确定的注视方向,摄像头可以聚焦到近场对象(靠近用户的花朵)或远场对象(例如远处的山脉)。

......(全文 3898 字,剩余 3445 字)

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

映维网会员可直接登入网站阅读

PICO员工可联系映维网免费获取权限