索尼专利申请可追踪AR交互外设触控笔等

追踪手/外设

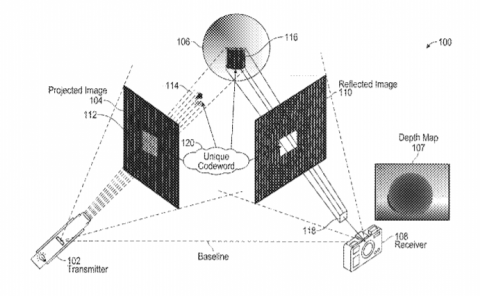

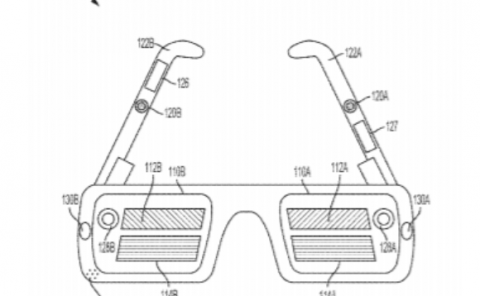

(映维网Nweon 2023年02月14日)对于AR,双手和诸如触控笔这样的外设都是重要的输入方式。所以,精确地追踪双手/外设十分关键。在名为“Augmented reality (ar) pen/hand tracking”的专利申请中,索尼就描述了一种用于追踪手/外设(例如触控笔)的方法。

如图2所示,人200以紧握的第一姿势用手202握住物体204,例如触控笔。在一个实施例中,物体204可以至少跨越普通人的手掌底部到中指指尖的长度,以便通过摄像头进行更准确的识别。

可以使用摄像头来生成手202和物体204的图像,并由头戴式显示器的一个或多个处理器处理,从而实现对手202和物体204的追踪,包括手202的姿势。

换言之,处理器采用的图像识别/计算机视觉(CV)算法识别手指和手相对于物体204的姿势,从而可以基于手与物体的交互来区分不同的手姿势。例如,处于握笔300姿势(图3)的手202与处于握持餐具400姿势(图4)的手不同。

......(全文 1930 字,剩余 1620 字)

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

映维网会员可直接登入网站阅读

PICO员工可联系映维网免费获取权限