Meta正式介绍Meta Reality:虚实融合的全彩透视技术

将融合虚拟和物理的全彩透视技术命名为“Meta Reality”

(映维网Nweon 2022年12月20日)Meta正在加紧研发能够融合虚拟和物理的相关技术,而支持全彩透视的Quest Pro正是成果之一。对于这项技术,团队日前正式将其命名为“Meta Reality”,并撰文进行了解释介绍。下面是映维网的具体整理:

从生产力和与同事的实时协作,到与朋友和家人一起外出,再到我们甚至没有想象过的新型游戏和交互式应用,MR混合现实可以打开各种独特体验的大门。VR将你完全沉浸在数字环境中,而MR则在允许你在享受虚拟内容的同时,在沉浸式体验中自由移动并与物理空间中的人和物进行交互,从而在VR中解锁一种全新的AR类体验,并且扩大你的物理空间。

Meta产品经理萨尔塔克·雷(Sarthak Ray)解释道:“能够看到你周围的物理世界,并将其与虚拟内容相融合,这为当今的虚拟现实带来了全新的可能性,比如你可以在同一个物理房间与朋友一起畅玩游戏,或者将巨大的虚拟显示器与物理工具相结合的生产力体验。这是我们迈向增强现实长期愿景的一步。”

有一种常见的误解是,混合现实可以通过在头显中显示物理世界的实时高分辨率视频来实现,但事实要复杂得多。令人信服的MR体验需要能够逼真自然地融合虚拟世界和物理世界,这意味着头显不仅仅只是将物理环境显示为2D视频。它实际上必须以数字化方式将房间重建为一个三维空间,并理解周围的物体和表面。这需要一个由多种硬件和软件技术组成的复杂系统,如高分辨率传感器、Passthrough、AI驱动的场景理解和空间锚点等等。所有这一切都以无缝和舒适的方式协同工作。

为了创建领先的VR技术,Meta正不断投资于原创研发,在设计中以人为本的同时,大规模地向消费者提供相关技术。我们专注于细节,深入探索人们如何感知周围的世界,并将这种感知与沉浸式体验联系起来,激发人们对虚拟现实和混合现实的可能性。今天,我们将为我们独特的混合现实系统采用一个全新的名称:Meta Reality。同时,我们将为你介绍真正一流MR体验的幕后。

用于空间感知的立体全彩透视

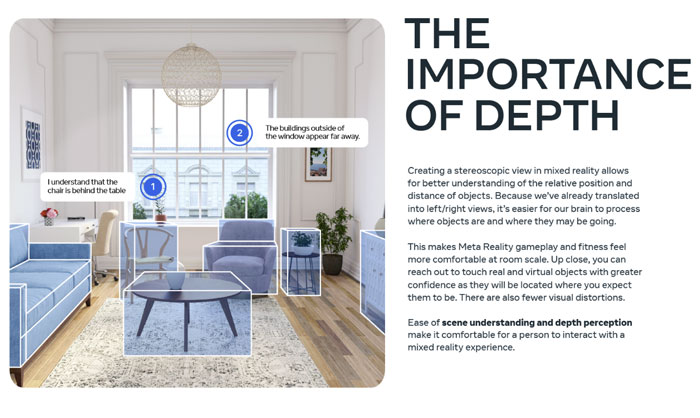

首先,真正的MR体验必须舒适,感觉自然。即使是高分辨率,无法传达深度感的直接视频馈送无法实现这一点。另外,如果Passthrough透视是单目视角和/或缺乏深度提示,用户可能会感到不适。为了提高Passthrough的舒适度,需要从两个不同的角度生成在单个眼睛缓冲区渲染的图像,从而提供立体提示。

为了应对这一挑战,我们的立体全彩透视解决方案使用定制的硬件架构、先进的计算机视觉算法和最先进的机器学习来模拟眼睛如何自然地感知周围的世界。更优的摄像头和显示器分辨率有助于提高图像质量,Quest Pro摄像头捕获的像素是Quest 2摄像头的四倍。但或许更重要的是,它基于图像的渲染、立体几何重建和深度理解建立了给定房间内对象相对于场景的位置。

这种新颖的算法堆栈允许Quest Pro能够识别房间几何的各个方面,并精确定位3D空间中对象的位置。所以,当你用立体全彩透视功能查看桌面的咖啡杯时,你的大脑会明白,咖啡杯比你手中的笔更远。

Meta计算机视觉工程经理里卡多·西尔韦拉·卡布拉尔(Ricardo Silveira Cabral)解释道:“Quest Pro结合了两个摄像头视图来重建真实的深度,这确保了使用全彩透视构建的混合现实体验对用户来说是舒适的。而且,即便深度重建不完美或超出系统范围,立体纹理提示都允许用户的大脑进行其余操作并推断深度。”

还记得Oculus Insight吗?我们的技术为消费者VR设备启用了第一个独立的全功能内向外追踪系统?我们升级了其深度传感能力,令其实时生成给定空间的密集3D表示。尽管Insight在一个房间中使用大约100个兴趣点来确定头显在空间中的位置,但Quest Pro的深度传感解决方案能够在各种自然和人工照明条件下为每帧最多可产生10000个兴趣点,最远可达五米。我们使用所述信息来创建物理世界的3D网格,在几个帧中组合输出,以生成密集的3D和时间稳定的空间表示。

然后结合网格与预测渲染来生成物理世界的图像。这意味着使用我们的异步时间扭曲技术将重建分别扭曲到头显的左眼视图和右眼视图。这项技术可以预测用户未来几毫秒的眼睛位置,从而补偿渲染延迟。

最后,添加颜色可以令体验看起来更真实。卡布拉尔指出:“全彩摄像头用于为立体视图上色,令体验尽可能接近现实世界。通过在整个流程中进行这种架构和优化,我们可以为Quest Pro为现有Quest 2内容,以及即将推出的MR应用程序提供立体全彩透视,无需额外的计算资源。这意味着开箱即用的技术。”

当你把所有这一切加起来时,Quest Pro的立体全彩透视会带来比单目视角解决方案更舒适的深度感知体验和更少的视觉失真,从而解锁高质量的房间规模混合现实体验。

将虚拟内容融入物理世界的场景理解

在Connect 2021大会推出Presence Platform中,Scene Understanding场景理解允许开发人员快速构建复杂的场景感知MR体验,实现与用户环境的丰富交互。

为了将复杂性降至最低,并帮助开发人员专注于构建他们的体验和业务,Meta将Scene Understanding场景理解作为一种系统解决方案。

- Scene Model场景模型是由几何和语义信息组成的单一、全面、最新和系统管理的环境表示。场景模型的基本元素是锚点,每个锚点都可以接到不同的组件。例如,用户的起居室围绕具有语义标签的单个锚点进行组织,如地板、天花板、墙壁、书桌和沙发。每一个都附加了一个简单的几何表示:二维边界或三维边界框。

- Scene Capture场景捕获是一个由系统引导的流程,它允许用户自由走动并捕获房间建筑和家具,从而生成场景模型。在未来,我们的目标是提供一个自动化版本的场景捕捉,不需要人们手动捕捉周围环境。

- Scene API这个界面允许应用程序在场景模型中查询和访问各种用例的空间信息,包括内容放置、物理、导航等。使用Scene API,开发人员可以使用场景模型令虚拟篮球从实际房间的物理表面反弹。

所以,Scene Understanding场景理允许开发者通过实时遮挡和碰撞效果构建尽可能可信和沉浸式的MR体验。

用于虚拟对象放置的空间锚点

Spatial Anchors空间锚点是帮助开发人员开始构建一流混合现实体验的核心功能。它们允许应用程序能够在空间中创建参考帧,从而允许虚拟对象随时间在空间中持续存在。多亏了空间锚点,产品设计师可以在《Gravity Sketch》中锚定多个3D示意图,或者一群朋友可以将《Demeo》的游戏世界锚定在他们的桌面。

空间锚点可以与场景模型锚点(墙、桌子、地板等)结合使用,从而创建丰富的体验和房间规模的自动放置。用户的房间成为游戏和生产力的空间渲染画布。开发人员可以选择将虚拟大门固定在物理墙壁。然后用户可以打开一个完全沉浸式的虚拟世界。

萝拉指出:“通过将场景理解与空间锚点相结合,你可以将MR体验与用户的环境相融合,以创造一个充满可能性的新世界。你可以在自己的客厅里成为一名特工,在房间里放置虚拟家具,或者在家里制作物理游戏等等。”

用于共同定位体验的共享式空间锚点

Meta已将Shared Spatial Anchors共享式空间锚点添加到Presence Platform。共享式空间锚点允许一个人创建的锚点与同一物理空间中的其他人共享。这允许开发人员为多个用户创建一个共享的世界锁定参考帧来构建本地多人游戏体验。例如,两个或两个以上的用户可以围坐在一起,共同畅玩虚拟棋盘游戏。

为了提供逼真有意义的MR体验,你需要将立体全彩透视、场景理解、空间锚点和共享式空间锚点、以及实时遮挡和碰撞、对象检测和照明信息组合在一个包中。所有这一切都需要考虑性能成本、计算和热量等约束条件。但最重要的是,确保舒适的体验是关键。

这只是一个开始。Meta Reality未来将通过软件更新和未来Meta Quest产品中的硬件进步继续优化。

Meta计算机视觉工程经理里卡多·西尔韦拉·卡布拉尔补充道:“Quest Pro是探索这项新兴技术的众多MR设备中的第一款。我们希望与开发者一同学习,因为他们创造了令人信服的体验,重新定义了VR头显的可能性。这个故事尚未结束,这只是第一页。”