苹果AR/VR专利提出根据眼动追踪为用户录制MR效果视频

录制从用户视角看到的画面

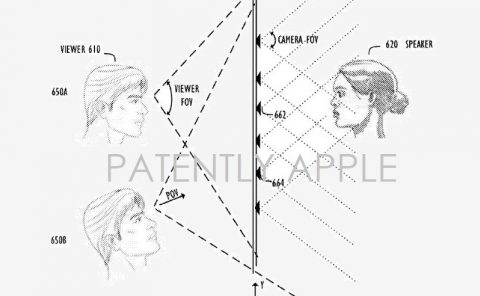

(映维网Nweon 2022年09月21日)对于MR眼镜/头显,一个可以想象的功能是视频录制,亦即捕获从用户视角看到的混合现实画面。在名为”Gaze-driven recording of video“的专利申请中,苹果就介绍了与之相关的功能。

苹果指出,在MR视频录制中,系统可以记录用户所能看见的一切。其中,用于说明录制区域的方框可以称为录制框。在一个实施例中,用户可以一直静态地注视感兴趣的内容。在另一个实施例中,用户视线会不断游动。为了录制从用户视角看到的画面,录制框必须跟随用户视线移动。所以,可以根据眼动追踪来实现录制框的移动。

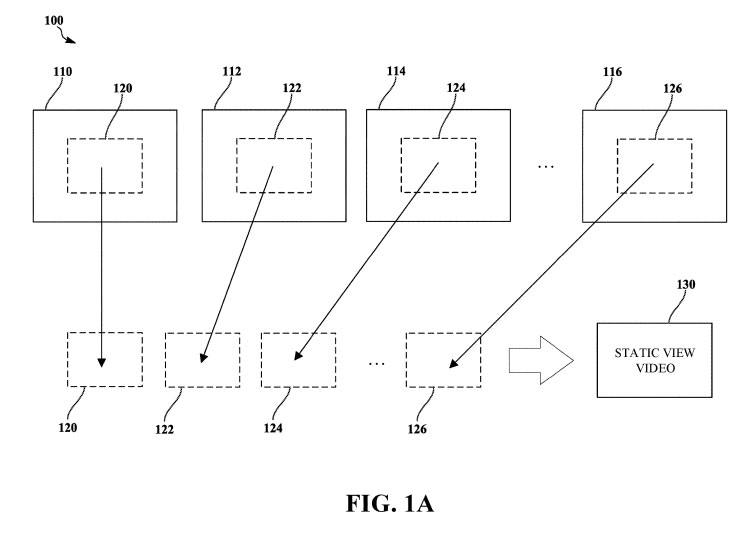

图1A是在静态感兴趣区域中记录视频的过程100。过程100将视频帧序列(110、112、114和116)作为输入,并记录视频帧的相应部分(120、122、124和126)。视频帧(110、112、114和116)可以包括使用一个或多个图像传感器捕获的视频数据,和/或显示给用户的虚拟环境的虚拟对象的图像。在这个示例中,视频帧的部分(120、122、124和126)对应于静态感兴趣区域,其中录制框每个都是位于相应视频帧(110、112、114和116)中心的像素矩形。

......(全文 2294 字,剩余 1925 字)

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

请微信扫码通过小程序阅读完整文章或者登入网站阅读完整文章

映维网会员可直接登入网站阅读

PICO员工可联系映维网免费获取权限