无需眼动追踪硬件,新方法用头部运动和视觉画面预测用户注视方向

无需专用眼动追踪硬件的注视预测方法

(映维网Nweon 2026年04月20日)注视预测在VR中发挥着关键作用,它能够减少传感器引起的延迟,并支持诸如注视点渲染等计算密集型技术。在一项研究中,来自希腊和塞浦路斯的研究团队提出了一种新颖的注视预测框架,将头戴式显示器的运动信号与视频帧中提取的视觉显著性线索相结合,无需眼动追踪设备就能预测用户注视方向。

对于VR应用,提前预判用户的注视方向有助于降低画面延迟、提升渲染效率,并改善交互体验。然而,有的VR头显并未配备眼动追踪功能,或出于隐私考虑限制了眼动数据的获取。针对这一问题,来自希腊和塞浦路斯的研究团队提出了一种无需专用眼动追踪硬件的注视预测方法。

所述解决方案仅利用头戴式显示器的运动信号(如头部转动的角速度、角位移)以及VR画面中的视觉显著性信息(即人眼可能关注的重点区域),即可预测用户在未来约三分之一秒到一秒内的注视位置。

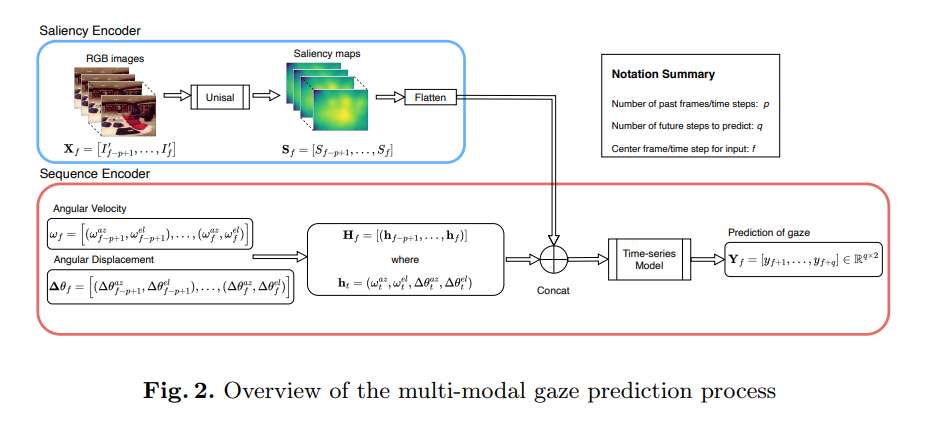

框架由两个核心模块组成:显著性编码器和序列编码器。显著性编码器提取与注意力相关的视觉特征,而序列编码器则将特征与实时头显运动信息相结合,以预测未来的注视方向。

研究人员使用公开的EHTask数据集进行测试,含30名受试者在观看360度视频时的真实眼动和头部运动记录。实验结果显示,新方法在333毫秒的预测窗口内,平均预测误差约为5.2度,显著优于仅以头戴设备中心作为注视点的传统方法(误差约10.1度)。当预测时间延长至1秒时,模型在前400毫秒内仍保持明显优势,之后误差逐渐增大。

在性能方面,研究团队在配备高性能显卡的Linux工作站上实现了实时运行。同时,模型转换为苹果CoreML格式,可在Apple Silicon芯片运行,并集成到Unity开发环境中,验证了在Apple Vision Pro等设备的可行性。

相关论文:REFA: Real-time Egocentric Facial Animations for Virtual Reality

研究的核心价值在于:在缺乏直接眼动数据的情况下,通过头部运动与视觉内容的结合,依然能够较为准确地预测用户注意力,从而降低VR系统的感知延迟,支持注视点渲染等性能优化技术,同时减少对用户隐私的潜在影响。